В 2023 году ведущие исследователи и руководители в области искусственного интеллекта призвали к шестимесячной паузе в обучении продвинутых моделей, предупредив о «серьезных рисках для общества и человечества». Правительства по всему миру отреагировали саммитами, заявлениями и рамочными программами — но мало что касалось принудительных действий. С тех пор передовые лаборатории выпустили все более крупные модели, производители микросхем, такие как Nvidia, побили рекорды оценки, а ИИ проник практически во все аспекты нашей повседневной жизни — от обслуживания клиентов до услуг, помогающих ученикам списывать в школах , и приложений для охраны психического здоровья . План действий Белого дома в области ИИ , хотя и всеобъемлющий по охвату и обнадеживающий в утверждении лидерства Соединенных Штатов в разработке и развертывании ИИ, укрепил акселерационистскую траекторию: сначала скорость, потом гарантии. На фоне этого ажиотажа в общественной сфере выкристаллизовалось одно настроение: тревога.

В отличие от прошлых волн технологической революции, тревога, связанная с ИИ, сочетает в себе экономическую незащищённость, техническую непрозрачность и политическое разочарование. Автоматизация с использованием ИИ угрожает рабочим местам « белых воротничков» и недавних выпускников , при этом увольнения и медленный рост числа рабочих мест происходят одновременно с рекордными прибылями корпораций, подрывая веру в обещание всеобщего процветания. Техническая проблема «чёрного ящика» — неспособность разработчиков объяснить или контролировать поведение модели — усугубляет эту тревогу, особенно по мере того, как системы ИИ интегрируются в процессы принятия решений , творческого производства и межличностного общения.

Центр бури усугубляется более широким общественным крахом доверия. Институты, которым долгое время было поручено производить и распространять знания — правительство, наука, СМИ — теперь сталкиваются с исторической поляризацией и скептицизмом. Социальные платформы, когда-то обещавшие расширение прав и возможностей, скатились в циклы « очернения »: снижение качества, рост эксплуатации и непрозрачность алгоритмов. Интеграция ИИ в бизнес-процессы рискует ухудшить эту динамику, передавая суждения на аутсорсинг без какой-либо ответственности. От, казалось бы, банального разочарования алгоритмическими ошибками до уклонения корпораций, усугубляющего недовольство рабочих мест и потребителей , общественность вынуждена считаться с преобразующей и разрушительной технологией — часто без её согласия и консультаций.

Могут ли правительства эффективно бороться с тревогой, связанной с ИИ? Маловероятно.

Регулирование — один из механизмов, используемых правительствами для решения коллективных проблем, изменяя поведение экономически и политически влиятельных субъектов. Однако закон работает только тогда, когда он может быть реализован и ощутим теми, кем он управляет. В случае с ИИ реализация закона нестабильна. Продолжающийся ажиотажный инвестиционный бум на строительство центров обработки данных и расширение энергосистем для обеспечения работы ИИ приближается к объёму инвестиций во время железнодорожного бума в XIX веке, превращая разработку ИИ в финансовый пузырь с сильными корыстными интересами, выступающими против надзора. Стремительные темпы и масштабы распространения ИИ всё больше превосходят бюрократические возможности. Эти проблемы вызывают серьёзные сомнения в том, что одно лишь вмешательство государства может эффективно решить общественные проблемы.

Разногласия среди экспертов формируют триаду ИИ

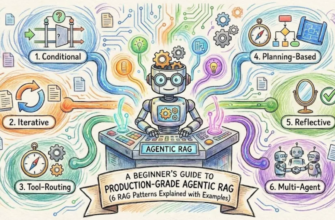

Дискуссия об управлении ИИ разделилась на три основных идеологических лагеря, также называемых триадой ИИ (формулировка, предложенная профессором права Гарвардского университета Джонатаном Зиттрейном): акселерационисты, сторонники безопасности и скептики. У каждого из них своё мировоззрение, сформированное разными представлениями о потенциале трансформации ИИ, объёме полномочий, которые можно доверить машинам, и о том, что следует делать сейчас.

Акселерационисты рассматривают ИИ как неизбежную и потенциально утопическую силу. В «Манифесте технооптимиста» Марк Андрессен, один из самых влиятельных венчурных капиталистов Кремниевой долины, рассматривает развитие ИИ как моральный императив и конкурентную необходимость для утверждения своего экономического, культурного и геополитического лидерства. Политические рекомендации этого лагеря предполагают рыночные меры с минимальным надзором и добровольными отраслевыми стандартами. Их мировоззрение нашло отражение в предложенном федеральном моратории на ИИ в «Большом красивом законопроекте» президента США Дональда Трампа, который бы лишил штаты возможности регулировать ИИ в течение десятилетия.

Сторонники безопасности, напротив, видят на горизонте экзистенциальную катастрофу. Для них главный вопрос заключается в том, как остановить или замедлить развитие ИИ до тех пор, пока ИИ не станет интерпретируемым и контролируемым. Такие деятели, как Дэниел Кокотайло и Элиезер Юдковски, утверждают, что стремительное развитие общего искусственного интеллекта (ОИИ) может обернуться катастрофой для человечества. Их видение регулирования требует срочных мер сдерживания: схем лицензирования передовых моделей, обязательных аудитов перед внедрением и международного режима координации стандартов безопасности. Например, законопроект SB 1047 в Калифорнии обязывал разработчиков крупных моделей ИИ предоставлять планы безопасности, проходить независимые аудиты и нести ответственность за причиненный ущерб, но был наложен вето губернатором Гэвином Ньюсомом (демократ).

Скептики, в свою очередь, отвергают предположение о наличии революционного потенциала или апокалипсиса. Такие учёные, как Арвинд Нараянан и Сайаш Капур, утверждают , что ИИ — это не исключение, а «норма» — как интернет или электричество, преобразующее, но всё ещё подверженное влиянию общества и государства. Они считают, что краткосрочные последствия ИИ — предвзятость, мошенничество, концентрация корпораций, экологические издержки — более серьёзны, чем гипотетический сверхинтеллект.

Политическая программа этой группы призывает к прагматичной адаптации: расширению полномочий Федеральной торговой комиссии по защите прав потребителей на ИИ , внедрению проверок предвзятости при найме на работу (как в местном законе 144 города Нью-Йорка ) и применению антимонопольного законодательства к консолидации отрасли ИИ.

Сторонники ускорения опережают регуляторов, создавая пробелы в управлении

Закон Европейского союза об ИИ , задуманный как первая в мире всеобъемлющая структура ИИ, стал наглядным примером того, как давление акселерационистов может подорвать благонамеренные усилия по управлению. Стремясь достичь «эффекта Брюсселя», как это сделал Общий регламент по защите данных (GDPR), установив глобальные стандарты конфиденциальности данных, Закон об ИИ был направлен на то, чтобы повлиять на международные компании и правительства, чтобы они приняли аналогичный строгий подход к регулированию. Однако по мере приближения к сроку его реализации лоббирование со стороны крупных технологических компаний , противодействие со стороны государств-членов и торговое давление США превратили Закон ЕС в размытый компромисс . То, что когда-то было объявлено вехой в глобальном управлении ИИ, рискует привести к систематизации корпоративных приоритетов, поскольку политические лидеры все больше поддаются влиянию аргументов акселерационистов.

В отличие от более жёсткого подхода Брюсселя к регулированию, Вашингтон исторически занимал более прорыночную позицию. Этот подход наделил американский технологический сектор беспрецедентной финансовой и политической мощью, позволив горстке компаний превратиться в квазисуверенные государства с влиянием, сопоставимым с влиянием национальных государств. Предупреждение историка Юваля Харари о том, что ИИ может концентрировать власть и подрывать демократию, теперь воплощается в жизнь в США в режиме реального времени, поскольку крупные технологические компании превращаются в крупные компании в сфере ИИ практически без ограничений со стороны государства.

С возвращением Трампа на пост президента отношения между Кремниевой долиной и Вашингтоном стали откровенно деловыми и личностно ориентированными. В Плане действий США в области ИИ ИИ рассматривается как гонка, в которой нужно победить, а не как технология, которой нужно управлять. За пределами Белого дома лоббирование отрасли усилилось на федеральном и региональном уровнях, гарантируя, что контуры политики в области ИИ будут формироваться теми, кто готов получить наибольшую выгоду от её ускорения.

Результатом является серьезный разрыв: в то время как общественность и гражданское общество в целом поддерживают ужесточение контроля над ИИ, как государственные, так и корпоративные лидеры стремительно приближаются к ИИ, не неся за это практически никакой ответственности.

К маловероятной коалиции

Разногласия между сторонниками безопасности и скептиками часто тормозили принятие конкретных мер регулирования, оставляя вакуум для доминирования акселерационистов. Почти полная отмена федерального моратория на ИИ вызвала тревогу . Однако его отмена в последнюю минуту также продемонстрировала потенциал необычной коалиции, способной защитить общественные интересы в сфере ИИ.

Историк Томас Дж. Сагру определяет маловероятные коалиции как союзы, основанные не на общей идеологии, а на общих интересах во времена кризиса. Объединённый профсоюз работников упаковочных заводов Америки (United Packinghouse Workers of America) 1940-х годов представляет собой поучительный прецедент: чернокожие и белые рабочие, разделённые расовыми и физическими барьерами, которые эксплуатировались работодателями, создали межрасовый альянс, который боролся за повышение заработной платы и улучшение условий труда.

Подобная «маловероятная коалиция» может и должна возникнуть в сфере управления ИИ среди исследователей , юристов и технологов движения , которые признают, что ускоряющаяся траектория ИИ — непрозрачная, ориентированная на прибыль и слабо управляемая — представляет собой системный риск, выходящий за рамки идеологии.

В Калифорнии уже проступают контуры этой конвергенции по конкретным проблемным вопросам. После того, как Ньюсом наложил вето на законопроект SB 1047, масштабный законопроект, ориентированный на передовые модели и соответствующий концепции безопасности, предполагающей строгий контроль перед внедрением, губернатор созвал Объединённую рабочую группу Калифорнии по политике в области искусственного интеллекта для разработки других альтернативных вариантов политики. Их рекомендации легли в основу законопроекта SB 53, представляющего собой прагматичный компромисс между тремя лагерями сторонников управления ИИ.

Законопроект признает экзистенциальный риск (забота сторонников безопасности), усиливает прозрачность и защиту осведомителей (требование скептиков и сторонников безопасности), облегчает бремя соблюдения требований по сравнению с SB 1047 и в то же время инвестирует в фонд для общественных вычислений (акселераторское решение).

Политические события вокруг законопроекта SB 53 ещё больше подчеркивают эту хрупкую, но многообещающую коалицию, которая преодолевает раскол между сторонниками безопасности и скептиками. Крупные игроки отрасли выступили против законопроекта. Однако Anthropic и другие академические и общественные организации одобрили его как сбалансированную основу для ответственных инноваций. Даже противники законопроекта SB 1047, такие как бывший советник Белого дома по вопросам политики в области искусственного интеллекта Дин Болл , высоко оценили законопроект SB 53 как более сбалансированный и технически реалистичный подход к управлению передовыми технологиями в области искусственного интеллекта.

Следующим рубежом для этой коалиции по управлению в поддержку ИИ является борьба с чрезмерной концентрацией власти — самим Большим ИИ.

Amazon, Microsoft и Google контролируют примерно две трети мировых облачных вычислений — инфраструктуры, от которой зависят все передовые модели искусственного интеллекта. Эти технологические гиганты осуществляют вертикальную интеграцию по мере того, как начинает формироваться экономика, интегрированная в ИИ : гиперскейлеры владеют чипами, облаками и долями в разработчиках моделей, таких как OpenAI и Anthropic. Эти так называемые «партнёрства» воспроизводят историческую тактику монополизации крупных технологических компаний, от покупки Instagram компанией Facebook до доминирования Google в сфере цифровой рекламы.

История подсказывает нам дорожную карту: Конгресс когда-то обязал железнодорожные компании отказаться от угля, обязал телекоммуникационные компании объединить сети и отделил инвестиции от коммерческих банков. Те же принципы должны применяться и к искусственному интеллекту. Чипы должны быть независимы от облаков, а облака — от моделей. Регулирующие органы должны отвергать перекрёстное владение, которое усиливает контроль над цифровой экономикой.

Коалиция, формирующаяся вокруг этих целей содействия конкуренции и защиты прав работников и потребителей, выходит за рамки партийных границ. Сторонники безопасности и скептики находят неожиданных союзников: от прогрессивных демократов, сосредоточенных на трудовом равенстве, до правых популистов, с подозрением относящихся к корпоративной власти. Бывший стратег Белого дома Стив Бэннон помог мобилизовать оппозицию федеральному мораторию на ИИ, представив его как подарком Кремниевой долине. Сенатор Джош Хоули (республиканец от штата Миссури) предложил ввести обязательный алгоритмический аудит и защиту авторских прав для деятелей искусств, в то время как сенатор Берни Сандерс (из штата Индиана от штата Вермонт) предложил «налог на роботов», чтобы перераспределить прирост производительности от автоматизации в пользу уволенных работников. Их сближение свидетельствует о зарождающейся двухпартийной повестке дня, в которой политики и влиятельные голоса с обеих сторон начинают рассматривать управление ИИ не как культурную войну, а как борьбу за экономическое равенство и институциональный контроль.

Беспокойство по поводу ИИ, если его не контролировать, приводит к параличу. Но если направить его в русло стратегической координации, оно может стать движущей силой перемен. Управление ИИ не должно диктоваться исключительно Кремниевой долиной или администрацией, стремящейся любой ценой выиграть гонку за ИИ. Его должно формировать гражданское общество, признающее ИИ технологией с преобразующим потенциалом — как позитивным, так и негативным, — которая требует демократической мобилизации и переговоров, а не технологической капитуляции. История показывает, что маловероятные коалиции способны перенаправить вышедшие из-под контроля системы. В случае с ИИ они могут быть не просто возможными — они могут стать нашей единственной надеждой.

Лам Тран — аналитик из Вашингтона, специализирующийся на технологической политике и отношениях между США и Азией. Она — бывший стипендиат программы AISST (лето 2025 г.) Центра Беркмана Кляйна по изучению Интернета и общества при Гарвардском университете и Кембриджской инициативы «Бостонское выравнивание», специализирующийся на управлении с помощью искусственного интеллекта.

Источник:

https://www.techpolicy.press/the-age-of-ai-anxiety-and-the-hope-of-democratic-resistance/