Публичные дискурсы стали чувствительны к этическим проблемам больших данных и искусственного интеллекта, поскольку скандалы о вторжении в частную жизнь, алгоритмической дискриминации и манипуляциях на цифровых платформах неоднократно попадают в заголовки новостей. Тем не менее, остается в значительной степени неизученным, как именно эти сложные вопросы представляются непрофессионалам и в какой степени новостные репортажи — как окно для технических дебатов — могут привить критическую грамотность в отношении данных. Настоящее исследование устраняет этот пробел в исследованиях и вводит понятие «риски данных».

Основная цель состоит в том, чтобы критически исследовать, как общественный и индивидуальный вред технологий, управляемых данными, попадает в общественную сферу и обсуждается там. В эмпирической части применяется дизайн смешанных методов, который сочетает в себе качественный и автоматизированный анализ контента для отображения рисков данных в новостных сообщениях, отобранных из известных англоязычных СМИ с мировым охватом. Результирующий перечень рисков, связанных с данными, включает вторжение/слежку в частную жизнь, предвзятость данных/алгоритмическую дискриминацию, кибербезопасность и информационный беспорядок. В исследовании риски, связанные с данными, рассматриваются как коммуникационные проблемы, подчеркиваются недостатки в публичных дискуссиях по этому вопросу и создаются стимулы для (практических) вмешательств, направленных на выяснение того, как датафикация и автоматизация могут иметь пагубные последствия для граждан. и информационный беспорядок. В исследовании риски, связанные с данными, рассматриваются как коммуникационные проблемы, подчеркиваются недостатки в публичных дискуссиях по этому вопросу и создаются стимулы для (практических) вмешательств, направленных на выяснение того, как датафикация и автоматизация могут иметь пагубные последствия для граждан. и информационный беспорядок. В исследовании риски, связанные с данными, рассматриваются как коммуникационные проблемы, подчеркиваются недостатки в публичных дискуссиях по этому вопросу и создаются стимулы для (практических) вмешательств, направленных на выяснение того, как датафикация и автоматизация могут иметь пагубные последствия для граждан.

Автор: Деннис Нгуен , Утрехтский университет , Нидерланды , d.nguyen1@uu.nl

- Введение

- Новостные репортажи и технологические дискурсы

- Технические новости и критическая грамотность данных

- Риски данных и формирование новостей

- Метод и данные

- Выводы

- Дистанционное чтение технических новостей

- Внимательное чтение новостей о риске данных

- Вторжение в частную жизнь и слежка

- Смещение данных и алгоритмическая дискриминация

- Информационная безопасность

- Информационный беспорядок

- Обсуждение

- Заключение

- Литература

Введение

Критические исследования данных (CDS) сосредоточены на этических проблемах и социальных рисках, связанных с данными и автоматизацией. Ключевыми темами являются недемократические иерархии власти, управляющие цифровой трансформацией (Taylor, 2017; van Dijck et al., 2021; Dencik & Sanchez-Monedero, 2022), эксплуатация и подчинение (Zuboff, 2019; Candry & Mejias, 2019), предубеждения и изоляция. Benjamin, 2019; D’Ignazio & Klein, 2020; Lopez, 2021), конфиденциальность, слежка и кибербезопасность (Solove, 2021; Landau, 2017), а также вредные последствия алгоритмического распространения контента (например, Ireton & Posetti, 2018). Эти аспекты риска сложны, контекстуальны и частично совпадают. Например, системы алгоритмического контроля могут вторгаться в частную жизнь людей и подвергать их дискриминационным методам управления, которые носят расистский характер (Browning & Arrigo, 2021). Многочисленные исследования подчеркивают негативные последствия преобладающей практики работы с данными и критикуют неравенство, несправедливость и неэтичное обращение с различными социальными группами (Dencik & Sanchez-Monedero, 2022). Учитывая их связь с технологиями, управляемыми данными, эти риски можно отнести к категориириски данных.

В то время как академический дискурс подчеркивает безотлагательность устранения рисков, связанных с данными, западные общественные дискурсы также стали чувствительны к этическим последствиям больших данных и искусственного интеллекта (ИИ). Скандалы о вторжении в частную жизнь, алгоритмической дискриминации и манипуляциях в социальных сетях неоднократно попадают в заголовки новостей (Hinds et al., 2020; Simon et al., 2020), что является «сейсмографом» для публичных дебатов. Тем не менее, похоже, что риски, связанные с данными, (пока) не стали заметной темой политических кампаний или социальной активности за пределами нишевых движений. Кроме того, лишь недавно в эмпирических исследованиях начали изучать взгляды неспециалистов на эти вопросы (Hartman et al., 2020). Опыт, отношения, мнения и действия формируются социотехническими образами и вносят свой вклад в социотехнические образы, возникающие в технологоцентричных дискурсах (Bareis & Katzenbach, 2022). С этой точки зрения критический анализ технических дискурсов выявляет иерархию власти и динамику распространенных нарративов, которые определяют, что представляет собой выгоду или риск (например, вред или угрозу), связанные с технологиями.

Хотя по каждой категории риска данных имеется обширная литература (Mejias & Shouldry, 2019; D’Ignazio & Klein, 2020; Wolff, 2022; Benjamin, 2019), до сих пор нет сравнительного взгляда на то, как они контекстуализируются и представляются более широкому кругу лиц. непрофессионалы, составляющие медийную общественность. Важные вопросы касаются определения рисков, связанных с данными, общих черт и различий между представлениями о рисках, предполагаемой срочности (и возможного ранжирования), а также реальных или воображаемых последствий для отдельных лиц и сообществ.

Есть две причины для зонирования в средствах массовой информации. Во-первых, средства массовой информации являются неотъемлемой частью создания общих сфер коммуникации за пределами отдельных сообществ в обществе (Peters, 2007). Новостные репортажи могут по-разному способствовать восприятию и оценке аудиторией цифровых технологий, например, посредством простых обзоров продуктов, критических репортажей о скандалах с данными или контекстуализации технологий .на фоне геополитических событий (Nguyen & Hekman, 2022a). С нормативной точки зрения, если у критической журналистики есть потенциал для повышения осведомленности о несправедливости, неравенстве и несправедливости в обществе, то аналогичные социальные проблемы, ключевыми факторами которых являются датафикация и автоматизация, не должны быть исключением. Однако, даже если журналистике не приписывать нормативную функцию, то, как новостные СМИ сообщают о технологиях, управляемых данными, и осмысливают их, все же может способствовать формированию социотехнических образов вокруг появляющихся технологий, т. е. того, как их доступность, влияние , в обществе воспринимаются польза, вред и риски (Vincente & Dias-Trindade, 2021).

Во-вторых, на индивидуальном уровне потребление новостей о датафикации и искусственном интеллекте потенциально может способствовать накоплению основанных на фактах знаний об этих проблемах и развитию критических взглядов. Репортажи о технических новостях можно рассматривать как компонент формирования «критической грамотности в отношении данных» (Nguyen & Nguyen, 2022): сочетание критических концептуальных и практических знаний и навыков о том, как системы, управляемые данными, влияют на личную конфиденциальность, цифровую безопасность, расширение прав и возможностей, и социальной справедливости. Это касается аудитории СМИ как граждан, так и профессионалов; То, что они узнают о технологиях из новостей, может повлиять на их личные и профессиональные взгляды. Однако грамотность в отношении критических данных касается и самих журналистских организаций.

Прежде чем можно будет оценить потенциальный вклад новостных репортажей в грамотность критических данных среди средств массовой информации, необходимо критически проанализировать существующие практики освещения рисков данных в новостях. Цель исследования — описать формирование рисков, связанных с данными, а затем оценить, как можно улучшить техническую журналистику, чтобы сделать ее более ценной для повышения грамотности критических данных среди непрофессиональной аудитории. Это может включать формирование такой грамотности в первую очередь в рамках журналистской профессии. Кроме того, анализ может помочь политикам и организациям оценить свои собственные стратегии информирования о рисках, связанных с данными.

Теоретическая основа настоящего исследования опирается на CDS, исследования средств массовой информации, теорию общественной сферы, социологию рисков и исследования в области формирования новостей. Эмпирическая часть объединяет вычислительные методы автоматизированного анализа контента ( дистанционное чтение ) с критическим обобщением репрезентативных примеров для новостных статей, в которых обсуждаются риски данных ( ближнее чтение ). Основное внимание уделяется большим данным и искусственному интеллекту из-за их заметности в современных публичных дискуссиях и распространенности связанных нарративов об их предполагаемом преобразующем потенциале. Они не отражают все технологические разработки, в которых имеют значение риски, связанные с данными, но являются подходящими примерами для изучения того, как технологические тенденции связаны с возможными недостатками.

Вычислительная часть использует тематическое моделирование (TM) для определения доминирующих тем в освещении технических новостей в сочетании с так называемым словарным подходом, который идентифицирует ссылки на риски в новостном контенте. Выборка включает основные и технические новостные агентства из США и Великобритании, которые освещали темы «искусственный интеллект» и «большие данные» в период с 2010 по 2021 год. выявлять моменты, когда конкретные риски, связанные с данными, привлекали внимание средств массовой информации. Выборка состоит из 5423 статей для дистанционного чтения; Для внимательного чтения было отобрано 400 статей. Полученные данные позволяют 1) выявить общие закономерности в новостях, сообщающих о рисках, связанных с данными, и 2) изучить, как риски, связанные с данными, определяются, толкуются и изображаются в новостях.

Статья построена следующим образом: во-первых, обсуждается роль технических новостей в публичных дискуссиях, которая связана с концепцией критической грамотности данных. Главный аргумент заключается в том, что новости о технологиях могут стимулировать появление более критической общественности в СМИ, способствуя их осведомленности и пониманию данных и автоматизации. Во-вторых, риски данных определяются как взаимосвязанные дискурсивные конструкции, которые возникают внутри, но также формируют социально-технические образы. Риски, связанные с данными, создаются человеком двумя основными способами: 1) посредством преднамеренного или непреднамеренного неэтичного использования технологий и 2) выбором слов, метафор, контекстов и ассоциаций, посредством которых они концептуализируются и обсуждаются в публичных дискуссиях. Это связывает риски данных с теорией формирования новостей. Третий, эмпирическое исследование сочетает в себе вычислительно-количественные и качественные методы посредством контент-анализа технических новостей. Результаты показывают, что риски, связанные с данными, явно присутствуют в дискурсах технических новостей англоязычных и западных стран, но ценность формирования критической грамотности в отношении данных среди непрофессионалов сильно различается в зависимости от стиля сообщения. Статья завершается критическим размышлением о роли технических медиа-дискурсов в принятии и регулировании технологий.

Новостные репортажи и технологические дискурсы

С западной точки зрения средства массовой информации в либерально-демократических политических системах идеально служат критическими наблюдателями за теми, кто находится у власти, и обеспечивают общий общественный форум для дискурсивной обработки вопросов, имеющих общественное значение (Peters, 2007). Хотя это идеализированное видение может показаться несоответствующим реальности, в которой динамические медиаландшафты формируются под влиянием экономического давления (Peterson, 2021), ориентации на элиту (van Duyn & Collier, 2018) и цифровой реконфигурации общественной дискурсивности (Bro & Wallberg, 2014), средства массовой информации по-прежнему необходимы для создания общих социальных контекстов (Goenaga, 2022; Langer & Gruber, 2020). Они могут быть не в состоянии охватить весь спектр точек зрения общества, но остаются влиятельными в определении того, какие вопросы, события, события,

Технологические тренды занимают центральное место в новостях. Прошлыми примерами являются ядерная энергия, нанотехнологии и биотехнологии (Cacciatore et al., 2012; Scheufele & Lewenstein, 2005; Marks et. al., 2007). Информационная ценность технологий проистекает из их социальных и экономических последствий, которые часто находятся в центре социальных, культурных и политических дискуссий (например, каковы приемлемые способы использования новой технологии? Должны ли новые технологии регулироваться, и если да, то как?). Новостные репортажи фокусируются на различных ожидаемых воздействиях технологий, уделяя особое внимание положительным и вредным последствиям. Распределение социальной значимости сильно различается между технологиями, и восприятие воздействия меняется с течением времени. Продольное развитие часто характеризуется приступами повышенного внимания общественности, связанными с инновациями, прорывами, инциденты и вмешательство регулирующих органов, за которыми последовала «засуха» внимания СМИ. Например, в период с 2000 по 2008 год нанотехнология была в центре все более широкого освещения в СМИ (Donk et al., 2011), но в настоящее время имеет ограниченное новостное значение.

Освещение технологических новостей сегодня во многом совпадает с освещением различных аспектов цифровой трансформации. Это происходит двумя конкретными способами репортажей о технических новостях. С одной стороны, все новостные разделы (например, политика, экономика, культура, спорт) должны учитывать внедрение и последствия цифровизации, датафикации и автоматизации. С другой стороны, технические новости превратились в дополнительный отдельный раздел новостей с разнообразным спектром тем. К ним относятся достижения в фундаментальных исследованиях, обзоры продуктов, развитие технологического бизнеса, скандалы с данными, техническое регулирование и другие истории, посвященные технологиям, основанным на данных (Nguyen & Hekman, 2022b). Новости технологий уделяют особое внимание тому, как данные и автоматизация проникают в различные сферы общественной и частной жизни, или имеют потенциал для этого в будущем.общественного интереса к цифровой трансформации как общественному явлению. В результате рост больших данных и ИИ заархивирован в новостном контенте по различным аспектам их преобразующего потенциала, ценности и рисков через призму журналистики. Средства массовой информации как наблюдатели за развитием технологий дают общее представление о современных технических дискурсах.

Они выполняют эту социальную функцию , выполняя двойную роль в публичных дискурсах: средства массовой информации являются не только комментаторами, но и сценами для текущих вопросов. Различные предпринимательские, политические и культурные взгляды находят общий этап в технических новостях, которые делятся тенденциями, взглядами и оценками с аудиторией СМИ. Таким образом, репортажи о технических новостях распространяют распространенные идеи, нарративы, предложения, отношения, темы и напряженность, которые «делают» современные технические дискурсы. Это включает в себя то, как технологии, управляемые данными, наполняются смыслом, связаны с ожиданиями и постепенно «нормализуются» в социальных областях.

Однако средства массовой информации не являются беспристрастными зеркалами технологических дискурсов, в которых заинтересованные стороны, не являющиеся СМИ, просто делятся своими взглядами, но предлагают свои собственные оценки проблем и заинтересованных сторон (Nguyen, 2017). Каждая новостная организация имеет свою идеологическую подоплеку, культурную среду, бизнес-модель и основные ценности, которые формируют журналистскую практику (Hepp et al., 2012). Как активные участники дискурса, средства массовой информации совместно формируют дискурсы о технологиях вместе с представителями бизнеса, исследований и политики. Это происходит на уровне публичной сферы посредством практик формирования новостей, определения повестки дня и подготовки. Для общественного восприятия и воображения важно, какие аспекты новых технологий находятся в центре внимания новостных репортажей, как они представлены и кто может говорить о них. Средства массовой информации вносят свой вклад в выделение общественной значимости и политизацию технических вопросов, что потенциально может стимулировать дискуссии об управлении технологиями. Или, наоборот, репортажи о технических новостях могут информировать средства массовой информации о технических разработках, которые ставят этические проблемы, требующие регулирования, и о том, как законодатели намерены их решать.

Технические тенденции могут быть трудны для понимания широкой публикой в зависимости от уровня воспринимаемой сложности или, другими словами, от того, насколько легко их можно объяснить доступным языком, облегчающим формирование ментальных моделей (Roskos-Ewoldson et al., 2004). Некоторые технологии являются «конкретными» (например, клонирование, гидроразрыв пласта), в то время как другие неуловимы и универсальны. Примерами последних являются большие данные и ИИ. Короче говоря, большие данные описывают различные формы сбора и анализа данных в огромных масштабах и с высоким уровнем детализации. ИИ — это общий термин для алгоритмов, которые используют большие объемы данных для автоматизации процессов. Помимо своего технического значения, оба термина имеют эпистемологические и идеологические коннотации, связанные с новым эмпиризмом данных и технологическим детерминизмом, которые трансформируют практики в различных секторах (Кухня, 2021). Учитывая затраты, связанные с разработкой, развертыванием и получением выгоды от больших данных и искусственного интеллекта, возникают вопросы о справедливости, доступе и демократии (Srincek, 2017).

Технические новости и критическая грамотность данных

Большие данные и ИИ практически вездесущи, но неспециалистам они кажутся абстрактными, что может привести к неправильному пониманию того, как работают данные и алгоритмы (Zarouali et al. 2021). Важным фактором, который может сформировать восприятие актуальности и воздействия, является ощутимая удаленность от непосредственного воздействия технологий. С большими данными и ИИ ситуация неоднозначная. Они кажутся абстрактными, сложными и трудными для понимания, однако цифровые системы, использующие данные и автоматизацию, распространены повсеместно. Все подвергаются «взгляду на данные» при взаимодействии с цифровыми интерфейсами. Они скрывают внутреннюю работу алгоритмов за тщательно подобранным и оформленным «пользовательским опытом» продуктов и услуг. Критические голоса указывают на отсутствие прозрачности, и компании, а также правительственные организации обвиняются в применении стратегического «черного ящика» для сокрытия их практики работы с данными (Pasquale, 2015). Роль цифровых технологий в повседневной жизни вызывает озабоченность у общественности, поскольку она затрагивает несколько важных социальных аспектов, таких как личное благополучие, рынки труда, экономический рост, социальное расслоение, культура, политика, безопасность и защищенность.

Лишь несколько исследований критически анализируют новостные сообщения о больших данных и искусственном интеллекте (Bunz & Braghieri, 2021; Paganoni, 2019; von Pape et al., 2017). Их основной исследовательский интерес заключается в изучении того, как освещение в новостях может повлиять на понимание гражданами данных и автоматизации. Это связано с критически важной информационной грамотностью и тем, как освещение технических новостей может способствовать ее повышению. Грамотность в отношении критических данных определяется здесь как концептуальные знания о датафикации и автоматизации среди неспециалистов и их способности формировать критические мнения (Nguyen, 2020). С этой точки зрения критическая грамотность в отношении данных в основном касается критического понимания 1) того, как методы работы с данными и алгоритмические системы напрямую влияют на людей в отношении, например, личной конфиденциальности, безопасности данных и справедливости (особенно в контексте автоматизированного принятия решений); 2) как организации накапливают власть и богатство с помощью данных и ИИ и что это означает для справедливого и открытого общества; 3) как отдельные граждане могут лучше защитить себя от вредоносной практики использования данных; и 4) как последствия больших данных и ИИ должны быть предметом (демократического) управления. Предлагаемый подход к грамотности в отношении критических данных связывает индивидуально-практические аспекты с социально-политическими аспектами и основывается на предыдущих предложениях, которые в основном сосредоточены на каждом из них в отдельности (Pangrazio & Selwyn; Gray et al, 2018).

Сообщая о проблемах конфиденциальности, злоупотреблениях данными, предвзятости данных и т. д., новостные СМИ могут предоставить своей аудитории важную информацию для критического осмысления данных и автоматизации. Тем не менее, средства массовой информации являются лишь одним из факторов формирования критической грамотности в отношении данных наряду с образованием и личным опытом. Тем не менее, что касается осведомленности и концептуального понимания больших данных и ИИ и их разнообразных эффектов, средства массовой информации выполняют важнейшую функцию информирования общественности. Фактически, основные средства массовой информации, такие как New York Times, прямо указали, что их технические репортажи направлены на то, чтобы помочь своей аудитории более критически относиться к влиянию технологий на общество и к тому, как лучше защитить себя (Chen, 2022).

Риски данных и формирование новостей

Риск как социологическое понятие не всегда четко определяется и достаточно обсуждается в критической литературе по исследованию данных. Большинство исследований сосредоточено на конкретных этических проблемах, связанных с определенным использованием технологий, управляемых данными. Анализ того, как риски становятся темами в публичных дискуссиях и как они оформляются, добавляет важный слой к критическому пониманию роли цифровых технологий в обществе. Средства массовой информации играют важную роль в построении социальной реальности, в том числе рисков как проблем, имеющих общественное значение и оказывающих ощутимое воздействие на различные части общества (Lupton, 2013). Новостные СМИ склонны придавать новостную ценность (Harcup & O’Neill, 2016) новым и эффективным технологиям, особенно если их влияние на общество вызывает споры. Отрицательные результаты, действительные или воображаемые, происходящие в настоящем или (неясном) будущем, являются естественной частью повествований СМИ о технологиях. Вызовы и риски — это дискурсивные конструкции, которые во многом зависят от контекста и точки зрения. Социально-культурная позиция отдельных лиц и социальных групп определяет восприятие того, какие тенденции, события и практики считаются «проблемными», а какие нет (Luhmann, 1991; Wynne, 2002; Beck, 2008). В определении риска в настоящем исследовании делается упор на потенциально негативное и вредное воздействие — преднамеренное, непреднамеренное, признанное или недооцененное — больших данных и ИИ. Риски не фиксированы, а «изменчивы», поскольку они возникают, изменяются и исчезают с течением времени. Изменение культурных норм, потребительских тенденций, политических тенденций и новых научных открытий — вот некоторые из факторов, формирующих риски и оценку их социальной значимости. Вызовы и риски — это дискурсивные конструкции, которые во многом зависят от контекста и точки зрения. Социально-культурная позиция отдельных лиц и социальных групп определяет восприятие того, какие тенденции, события и практики считаются «проблемными», а какие нет (Luhmann, 1991; Wynne, 2002; Beck, 2008). В определении риска в настоящем исследовании делается упор на потенциально негативное и вредное воздействие — преднамеренное, непреднамеренное, признанное или недооцененное — больших данных и ИИ. Риски не фиксированы, а «изменчивы», поскольку они возникают, изменяются и исчезают с течением времени. Изменение культурных норм, потребительских тенденций, политических тенденций и новых научных открытий — вот некоторые из факторов, формирующих риски и оценку их социальной значимости. Вызовы и риски — это дискурсивные конструкции, которые во многом зависят от контекста и точки зрения. Социально-культурная позиция отдельных лиц и социальных групп определяет восприятие того, какие тенденции, события и практики считаются «проблемными», а какие нет (Luhmann, 1991; Wynne, 2002; Beck, 2008). В определении риска в настоящем исследовании делается упор на потенциально негативное и вредное воздействие — преднамеренное, непреднамеренное, признанное или недооцененное — больших данных и ИИ. Риски не фиксированы, а «изменчивы», поскольку они возникают, изменяются и исчезают с течением времени. Изменение культурных норм, потребительских тенденций, политических тенденций и новых научных открытий — вот некоторые из факторов, формирующих риски и оценку их социальной значимости. Социально-культурная позиция отдельных лиц и социальных групп определяет восприятие того, какие тенденции, события и практики считаются «проблемными», а какие нет (Luhmann, 1991; Wynne, 2002; Beck, 2008). В определении риска в настоящем исследовании делается упор на потенциально негативное и вредное воздействие — преднамеренное, непреднамеренное, признанное или недооцененное — больших данных и ИИ. Риски не фиксированы, а «изменчивы», поскольку они возникают, изменяются и исчезают с течением времени. Изменение культурных норм, потребительских тенденций, политических тенденций и новых научных открытий — вот некоторые из факторов, формирующих риски и оценку их социальной значимости. Социально-культурная позиция отдельных лиц и социальных групп определяет восприятие того, какие тенденции, события и практики считаются «проблемными», а какие нет (Luhmann, 1991; Wynne, 2002; Beck, 2008). В определении риска в настоящем исследовании делается упор на потенциально негативное и вредное воздействие — преднамеренное, непреднамеренное, признанное или недооцененное — больших данных и ИИ. Риски не фиксированы, а «изменчивы», поскольку они возникают, изменяются и исчезают с течением времени. Изменение культурных норм, потребительских тенденций, политических тенденций и новых научных открытий — вот некоторые из факторов, формирующих риски и оценку их социальной значимости. 2008). В определении риска в настоящем исследовании делается упор на потенциально негативное и вредное воздействие — преднамеренное, непреднамеренное, признанное или недооцененное — больших данных и ИИ. Риски не фиксированы, а «изменчивы», поскольку они возникают, изменяются и исчезают с течением времени. Изменение культурных норм, потребительских тенденций, политических тенденций и новых научных открытий — вот некоторые из факторов, формирующих риски и оценку их социальной значимости. 2008). В определении риска в настоящем исследовании делается упор на потенциально негативное и вредное воздействие — преднамеренное, непреднамеренное, признанное или недооцененное — больших данных и ИИ. Риски не фиксированы, а «изменчивы», поскольку они возникают, изменяются и исчезают с течением времени. Изменение культурных норм, потребительских тенденций, политических тенденций и новых научных открытий — вот некоторые из факторов, формирующих риски и оценку их социальной значимости.

Средства массовой информации могут информировать непрофессионалов о различных проявлениях преимуществ и рисков технологий для различных социальных групп (Paek & Hove, 2017). Освещение вопросов в новостях способствует изображению «рискованности» и размеров эффекта. Это может формировать восприятие технологии и формирование отношения посредством практики фрейминга, т. е. того, какие части сложных реалий новостные репортажи освещают с разным оценочным акцентом. Создание новостей прямо или косвенно способствует общественному пониманию технологических преобразований. Это не означает, что средства массовой информации должны выполнять нормативную функцию в качестве каких-то непредвзятых, беспристрастных и объективно-критических наблюдателей (чего они, взятые в целом, не могут). Точные способы, которыми новости освещают и изображают технологии, зависят от различных факторов,

Например, Лаор и др. (2021) показывают, как популярность Pokemon GOмобильная игра вызвала панику в СМИ в дискурсе израильских новостей, сосредоточенном на предполагаемом негативном влиянии дополненной реальности на здоровье и безопасность пользователей. В данном случае новости преувеличивали недостатки технологий. Для немецкого контекста von Pape et al. (2017) показывают, как проблема конфиденциальности стала тонкой темой для новостных репортажей, которые критически освещают практику работы с данными в организациях. Со временем появились разные взгляды, оценки и обостренное чувство важности проблемы. В то время как скандалы и утечки данных влияют на освещение вопросов конфиденциальности в новостях, авторы показывают, что «изменения происходят в результате событий, которые могут улучшить конфиденциальность в будущем» (von Pape et al., 2017: 1). Однако восприятие риска в медиа-дискурсах не обязательно совпадает с восприятием риска в сообществах и/или на индивидуальном уровне. Что касается вопросов конфиденциальности,

Обрамление новостей может оказывать «эффект осведомленности» на аудиторию, просто информируя ее о том, какие аспекты проблемы находятся в общественной повестке дня, особенно в отношении преимуществ и рисков. Одним из примеров является скандал Cambridge Analytical с участием Facebook в 2017 году. Широкое внимание средств массовой информации выдвинуло вопрос о вторжении в частную жизнь и манипулировании в общественную повестку дня. Настолько, что генеральный директор Facebook/Meta Марк Цукерберг был приглашен в Конгресс США, чтобы объяснить практику работы с данными в своей компании (в основном политикам, неграмотным в области данных и цифровых медиа). Средства массовой информации придали этому делу огласку, что указывало на общественную значимость. Они критически прокомментировали действия компании и реакцию регуляторов после разоблачения скандала. Они сделали этические вопросы вокруг «Больших технологий» предметом публичного обсуждения.

Здесь необходимо критически отметить несколько моментов. Во-первых, существуют натянутые отношения между организациями средств массовой информации и крупными онлайн-платформами, которые коренным образом изменили медиаландшафт за последние два десятилетия. Средства массовой информации в целом выиграют от более строгого регулирования технологических компаний. Во-вторых, средства массовой информации не обязательно точно изображали проблему и ее масштабы, а сенсационность не редкость в освещении технических скандалов. В-третьих, средства массовой информации не обладают монополией на публичный дискурс. Социальные сети охватывают миллиарды пользователей и предлагают большой потенциал для создания альтернативных публичных сфер, даже несмотря на то, что ими могут управлять и эксплуатировать компании, стоящие за ними. Отношения между средствами массовой информации и социальными сетями следует понимать как взаимовлияющие. Это не означает, что они одинаково сильны или одинаково важны для всех аудиторий. Тем не менее, нельзя обоснованно утверждать, что средства массовой информации не имеют отношения к цифровой публичной сфере. В-четвертых, культурный контекст имеет значение для того, как новостные организации работают и, в конечном итоге, формулируют проблемы, включая большие данные и искусственный интеллект. Хотя они и не связаны никакими национальными границами, точные проявления данных и автоматизации, их скорость и вертикальный охват социальных слоев в значительной степени определяются региональными и местными структурами развития и внедрения технологий. Эти рамки состоят из культурных, политических, экономических и регуляторных факторов, причем один влияет на другой. На «глобальном Западе»

Основываясь на вышеизложенном, в настоящем исследовании предлагается следующий исследовательский вопрос: как средства массовой информации определяют риски, связанные с данными, при освещении больших данных и искусственного интеллекта? Путем анализа распространенных практик фрейминга новостные репортажи будут подвергаться критической оценке на предмет их возможной значимости для повышения грамотности критических данных среди аудитории СМИ.

Метод и данные

Чтобы изучить технические новости в отношении «рамок акцента» (Chong & Druckman, 2007), тематическое моделирование с использованием скрытого распределения дирихле (LDA) было применено к выборочному текстовому корпусу с помощью пакета GENSIM для Python (Řehůůřek & Sojka, 2010). Рамки акцента обозначают тематические фокусы в новостях, т. е. различные контексты, в которых обсуждаются технологические тренды (Burscher et al., 2016). После этого образцы статей, посвященных рискам данных, были отобраны для качественного контент-анализа.

Новостные статьи были получены из пяти англоязычных основных и ориентированных на технологии новостных агентств: The New York Times (NYT), The Guardian , Wired и Gizmodo.Они имеют широкий охват среди англоязычной аудитории и сосредоточены на больших данных и искусственном интеллекте. NYT и Guardian считаются основными газетами, которые освещают широкий круг тем, но также часто сообщают о технологических разработках. Wired и Gizmodo — это техноцентрические издания, которые имеют меньший круг тем и освещают технологии, связанные с социальными, политическими и культурными последствиями. Хотя эта выборка имеет ограничения для исследования глобальных технологических дискурсов, она все же позволяет исследовать, как влиятельные основные и технические новостные СМИ понимают возникающие технологические тенденции. Анализ сосредоточен на десятилетии между 2010 и 2021 годами, в течение которого большие данные и искусственный интеллект претерпели ряд инноваций, нашли более широкое применение в обществе и часто освещались в новостях.

Соответствующие статьи были определены с помощью поиска по ключевым словам «большие данные» и «искусственный интеллект»/«ИИ». Всего было опубликовано 17 813 статей. Однако во многих статьях большие данные или искусственный интеллект упоминаются лишь вскользь. Чтобы повысить вероятность того, что в статьях явно обсуждаются большие данные и/или искусственный интеллект, был установлен дополнительный критерий отбора (Burscher et al., 2016): поисковые термины должны встречаться в заголовке/заголовке статьи не менее одного раза или не менее трех раз. в основном тексте. Это сократило объем данных до 5 423 статей ( таблица 1 ). Ручная проверка случайной выборки из 250 статей подтвердила, что ок. 85% статей действительно в основном касались больших данных и/или искусственного интеллекта.

| Выход | ИИ | Большие данные |

|---|---|---|

| Нью-Йорк Таймс | 2229 | 866 |

| Страж | 111 | 160 |

| Проводной | 1375 | 475 |

| Гизмодо | 102 | 105 |

Новостные тексты были предварительно обработаны стандартными методами НЛП (например, лемматизация, перевод в нижний регистр, выбор признаков, удаление стоп-слов) до моделирования темы. Ключевой проблемой в тематическом моделировании является выбор количества тем, которое необходимо задавать вручную и которое может показаться весьма субъективным. Одним из статистических подходов к сокращению «оптимального» количества тем является расчет так называемых показателей согласованности для разных номеров тем. Высокие показатели согласованности связаны с более высокой интерпретируемостью созданных тем человеком (Atteveldt et al., 2022). Однако они являются просто эвристикой, и для подтверждения того, действительно ли кластеры одновременно встречающихся слов образуют различимые темы, необходима человеческая проверка. Были рассчитаны баллы согласованности для 2-20 тем. Для предварительно обработанного корпуса текстов 12 тем имели самый высокий балл связности (0,47). Ручная проверка первых десяти ключевых слов по каждой теме и изучение примеров подтвердили, что 12 тем были связными и интерпретируемыми. Два исследователя независимо обозначили темы, а затем обсудили свои результаты, прежде чем остановиться на окончательных метках, которые точно описывают каждую тему. Наконец, был составлен словарь с релевантными ключевыми словами в качестве индикаторов конкретных рисков данных на основе соответствующей литературы и наблюдений при внимательном чтении (таблица 2 ; Нгуен и Хекман, 2022b). Всякий раз, когда в статье упоминался индикатор, соответствующий риск данных учитывался как присутствующий в статье.

Чтобы проверить согласие человека и компьютера, была выбрана случайная выборка (N = 250) для ручного кодирования, чтобы проверить наличие указанных рисков данных. В процесс были вовлечены два кодировщика-человека, надежность интеркодера между ними и автоматический анализ контента достигли KALPHA=0,80 (Hayes & Krippendorff, 2007). Однако явным ограничением является то, что словарь включает только те показатели, которые были выявлены в ходе качественного анализа. В нескольких случаях (около 15%) индикаторы, присвоенные рискам данных, не были напрямую связаны с большими данными и/или ИИ из-за отсутствия понимания контекста словарного подхода.

Хотя вычислительные методы обеспечивают быстрый обзор общих тенденций, они бесполезны для исследования фрейминга в отношении нюансов использования слов и, следовательно, недостаточны для более всестороннего критического анализа, если их применять отдельно. Таким образом, внимательное чтение текстов новостей ручными методами было необходимо для получения более детального и сложного аналитического впечатления от репортажей о технических новостях.

| Риск данных | Индикаторы (примеры) |

|---|---|

| Вторжение в частную жизнь / наблюдение | Вторжение в частную жизнь, слежка |

| Смещение данных/алгоритмическая дискриминация | Расизм, сексизм, дискриминация |

| Информационная безопасность | Киберпреступность, кража данных |

| Информационный беспорядок | Фейковые новости, дезинформация |

Чтобы изучить, как именно обсуждаются риски, связанные с данными, в конкретном контексте, было случайным образом выбрано 400 статей (по 100 на каждую основную категорию рисков данных) для внимательного чтения. Качественный контент-анализ был сосредоточен на темах, методах построения, метафорах, а также на глубине дискуссий о данном риске данных.

Выводы

Дистанционное чтение технических новостей

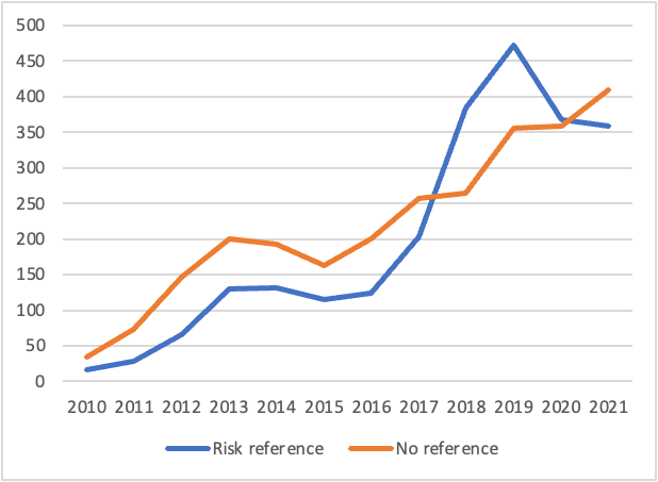

Количество статей, посвященных большим данным и искусственному интеллекту, с годами росло, причем заметное увеличение произошло в середине 2010-х годов ( рис. 1 ). Подъем и падение внимания средств массовой информации к техническим ключевым словам, по-видимому, совпадают с «циклами ажиотажа»: в период с 2010 по 2013 год большие данные привлекли значительное внимание в исследованиях и бизнес-дискурсах. В последующие годы внимание переключилось на ИИ. Вероятными причинами этого являются прорывы в области машинного обучения, нейронных сетей и внедрение приложений ИИ в различных областях. Однако после пика в 2021 году количество статей об ИИ (и больших данных) значительно сократилось.

Результаты тематического моделирования подразумевают, что большие данные и ИИ обсуждаются в различных контекстах, которые обычно относятся к исследованиям и разработкам, платформам и продуктам, а также к влиянию на социальные сферы. Двенадцать различных тем, возникших в результате анализа ( таблица 3 ), далее сгруппированы в четыре более крупные темы ( таблица 4 ).

| Тема | Н | % от общего |

|---|---|---|

| Международная политика и финансы | 590 | 10,9 |

| ИИ, роботы и технологии | 606 | 11,2 |

| Платформы и техническая инфраструктура | 653 | 12,0 |

| Технические продукты | 232 | 4,3 |

| ИИ и машинное обучение | 345 | 6,4 |

| Международная политика и безопасность | 524 | 9,7 |

| ИИ и технические исследования | 422 | 7,8 |

| Политика США | 616 | 11,4 |

| ИИ, платформы и здравоохранение | 600 | 11,1 |

| Технология искусственного интеллекта и конфиденциальность | 466 | 8,6 |

| Технические платформы и международная политика | 240 | 4,4 |

| Искусство и культура | 129 | 2,4 |

| ОБЩИЙ | 5423 | 100 |

| Тема | Н | % Общий |

|---|---|---|

| ИИ, большие данные и политика

(темы 1, 6, 8, 11) |

1970 | 36,3 |

| ИИ и исследования больших данных

(темы 2, 5, 7) |

1373 | 25,3 |

| Крупные технологические платформы и продукты

(темы 3, 4) |

885 | 16,3 |

| Автоматизированное информационное общество

(темы 9, 10, 12) ОБЩИЙ |

1195

5423 |

22,0

100 |

Представление о больших данных и искусственном интеллекте, по-видимому, претерпело диверсификацию из научной темы в вопрос более широкой социальной значимости и растущей политизации ( рис. 2 ). Изображение больших данных и искусственного интеллекта как политических вопросов с 2016 года становится все более заметным и касается как национальной, так и международной политики. Поскольку большинство выбранных новостных агентств базируются в США, это часто связано с политикой США на национальном уровне, но также часто связано с Китаем на мировой арене.

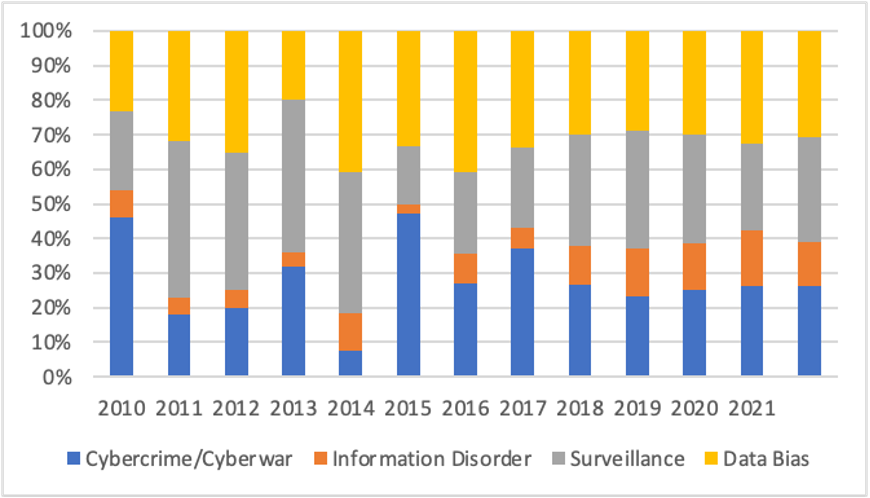

В ходе ручного контент-анализа были выявлены четыре основные категории риска данных, которые затем были количественно определены с помощью компьютерного анализа: киберпреступность/кибервойна , информационный беспорядок (дезинформация и дезинформация), слежка и предвзятость данных .. Каждая категория определена и исследована более подробно ниже, но перед этим на рисунках 3-5 представлен общий обзор удаленного чтения. Количество явных ссылок на риски данных в новостных статьях со временем увеличивалось. В совокупности 47 % статей, посвященных ИИ, и 46 % статей, посвященных большим данным, содержат ссылки на риски, связанные с данными. Это означает, что технические новости стали более внимательно относиться к этим вопросам. Однако с 2020 года явные ссылки на риски данных начали исчезать. Примечательно, что только конфиденциальность и безопасность (связанные с кибервойной/киберпреступностью) стали доминирующими (частичными) темами в тематическом моделировании ( таблица 3 ), в то время как все другие риски, связанные с данными, выступают в качестве подпараметров других новостных фреймов.

Четыре основных типа риска данных представлены в статьях как для ключевых слов «большие данные», так и для ИИ. На рисунках 4 и 5 показано, как четыре категории были распределены в новостных статьях, которые включали любые ссылки на риски за данный год.

Есть несколько заметных отличий: в начале 2010-х некоторые категории риска, такие как информационный беспорядок и предвзятость данных, вообще не присутствовали в статьях, ориентированных на большие данные. Глядя на различия категорий риска по техническим терминам ( таблица 5 ), статьи об ИИ, похоже, чаще ссылаются на предвзятость данных, чем статьи, посвященные большим данным (20,4% против 15,7%, N = 5423, χ2 = 29,33, df = 1, р = 0,01). И наоборот, статьи о больших данных чаще содержат ссылки на слежку и вторжение в частную жизнь (20,0% против 29,6%, N = 5423, χ2 = 35,50, df = 1, p = 0,01).

| Информационная безопасность | информационное расстройство | Наблюдение | Databias | Н | |

|---|---|---|---|---|---|

| ИИ | 662 (17,3%) | 315 (8,3%) | 764 (20,0%) | 777 (20,4%) | 3817 |

| Большие данные | 263 (16,8%) | 77 (4,9%) | 475 (30,4%) | 252 (16,1%) | 1561 |

Эта разница не совсем удивительна. В раннем дискурсе больших данных вопросы о том, как расширение сбора данных вторгается в частную жизнь людей, были общей проблемой, что привело к попыткам более строгого регулирования процессов обработки данных, например, в европейском контексте. Решения ИИ часто служат для форм автоматизированного принятия решений о людях и могут воспроизводить или создавать новые неравенства и предубеждения. Этот риск стал более очевидным с фактическим развертыванием решений ИИ в разных областях. Эти наблюдения подразумевают, как продолжающееся развитие технологий и их внедрение в новых условиях приводят к «обнаружению» новых рисков.

Внимательное чтение новостей о риске данных

Вторжение в частную жизнь и слежка

Вторжение в частную жизнь и слежка описывают незапрошенный сбор пользовательских данных для различных экономических и/или политических целей, которые часто остаются скрытыми от пользователей. Конкретными примерами являются скрытые средства отслеживания данных в приложениях, файлы cookie, сбор данных из профилей социальных сетей без согласия или утечка данных. Вторжение в частную жизнь / слежка — один из наиболее заметных рисков, связанных с данными, в западных публичных дискуссиях, которые стали более критически относиться к преобладающим методам работы с данными. Это отражено в технических новостях, где широко упоминаются формы вторжения/слежки в частную жизнь. Степень объяснения неэтичных методов сбора данных значительно различается в разных новостных статьях. Например, освещение конкретных споров с участием крупных технологических компаний пытается объяснить, что такое вторжение в частную жизнь, например, с помощью средств отслеживания данных для непрофессионалов (т.Все, что вам нужно знать о Facebook и Cambridge Analytica [Wired, 2018]). В авторских статьях особенно откровенно говорится о том, что нынешние методы работы с данными несут риски для личной конфиденциальности (« Бросьте свой ноутбук в море, экономика слежки все равно победит» [NYT, 2019]; «Как крупные технологические компании планируют извлечь выгоду из пандемии» [NYT, 2021]). . В статьях, посвященных вопросам конфиденциальности, обсуждаются более широкие последствия тенденций в области обработки данных (например, « Переосмысление конфиденциальности в эпоху больших данных» [NYT, 2012]; « Сколько стоят ваши личные данные?» [Guardian, 2014]); отчет о попытках технологического регулирования (например, «Почему Силиконовая долина должна бояться главного конкурента Европы» [WR, 2018]);Британская комиссия призывает к ужесточению антимонопольных правил в отношении технологических гигантов [NYT, 2019]); или объяснить, как продукты и услуги могут быть сопряжены с риском для личной конфиденциальности (например, RunKeeper рассказывает об умных часах, iPhone 5s и проблемах конфиденциальности для фитнес-приложений [Guardian, 2013]; A Sneaky Path Into Target Customers’ Wallets [NYT, 2014]).

Однако во многих статьях вопросы конфиденциальности упоминаются лишь вскользь, без дальнейшего обсуждения того, как они влияют на отдельных людей. Точные негативные последствия для пользователей остаются неясными даже в статьях, которые явно сосредоточены на скандалах, связанных с вторжением в частную жизнь, за исключением государственного наблюдения за данными в целях безопасности и контроля. Что касается «пользователей, не принадлежащих к меньшинствам», кажется трудным проиллюстрировать точный ущерб от вторжения в частную жизнь и слежки, поскольку последствия неэтичных методов работы с данными в высшей степени случайны, частично непредвидимы и потенциально невидимы для конкретных людей. Наиболее конкретными негативными последствиями, упоминаемыми в новостных статьях для рядовых пользователей, обычно являются угрозы манипулирования в социальных сетях и таргетированная онлайн-реклама.

Смещение данных и алгоритмическая дискриминация

С появлением автоматизированных систем принятия решений, которые ранжируют и классифицируют людей, различные инциденты, связанные с предубеждениями и дискриминацией, попали в заголовки новостей в последние годы. Как и в случае с конфиденциальностью, статьи сильно различаются по глубине обсуждения этих вопросов. Предвзятость данных связана с формами расизма, сексизма, эйджизма, эйблизма и их различных пересечений. Точные формы и эффекты снова зависят от контекста, но новостные статьи, как правило, касаются четырех основных категорий: во-первых, предвзятость данных, которая приводит к исключению из эффективного использования технологий (например, «Лучшие алгоритмы все еще борются за распознавание черных лиц») .[Wired, 2019]). В соответствующих статьях объясняется, почему определенные демографические группы не могут пользоваться технологиями в той же степени, что и другие. Вторая категория касается предубеждений, которые приводят к социальным и экономическим недостаткам в системах классификации. Примерами могут служить автоматизированные решения для найма, которые отражают историческую предвзятость в отношении женщин и меньшинств (например, The Commonality of AI and Diversity [NYT, 2018]). Затронутые группы находятся в невыгодном положении, которое часто глубоко укоренено в данных, используемых для разработки таких систем (например, « Восстание расистских роботов» — как ИИ изучает все наши худшие импульсы [Guardian, 2017]). Однако в некоторых статьях объясняется, как ИИ может иметь обратный эффект и может преодолевать человеческие предубеждения в одних и тех же областях (например,Стартапы используют технологии для изменения процесса найма [NYT, 2017]). Третья категория состоит из управляемых данными систем для охраны и контроля над населением, в которых определенные демографические группы чрезмерно представлены в невыгодном для них направлении (например, « Поскольку камеры отслеживают жителей Детройта, возникают дебаты по поводу расовой предвзятости» [NYT, 2019]; ICE использовала распознавание лиц). в базу данных водительских прав штата [NYT, 2019]). Проблема не в исключении из технологий, а в том, как данные и ИИ способствуют маргинализации и стигматизации. Четвертая категория относится к неправильной категоризации людей в системах ИИ (например, «ботаник», «некурящий», «нарушитель»: как ИИ может навесить на вас ярлык? [NYT, 2019]).

Новостные репортажи, как правило, обнаруживают причины в неосведомленности / невежестве создателей технологий о том, как их системы влияют на различные социальные группы или государственную политику, которая имеет дискриминационные последствия. Причины представлены как культурные предубеждения, несколько специфичные для технологического сектора, и/или общие модели маргинализации и дискриминации, имеющие исторические корни в обществе. В статьях предвзятость данных связывается с вопросами подотчетности (например, « Конечно, ИИ силен, но можем ли мы сделать его подотчетным?» [Wired, 2016]) и регулирования (например, « Нам нужен закон, чтобы спасти нас от антиутопии» [NYT, 2019]). . Это также изображается как общая проблема ИИ ( Каковы самые большие проблемы, которые технология должна преодолеть в следующие 10 лет?[Гизмодо, 2019]). Некоторые новости уравновешивают недостатки предвзятости данных как риска с преимуществами основанных на данных решений практических проблем (например, может ли анализ голоса с помощью ИИ помочь в выявлении психических расстройств? [NYT, 2022]).

В целом, различные модели предвзятости данных сосредоточены на двух измерениях эффекта риска: 1) конкретных случаях, когда технологии исключают, маргинализируют или нацеливают определенные демографические группы в невыгодное положение, и 2) предвзятости данных как общего риска в обществе неопределенного воздействия, которое потенциально становится более актуальным с ростом использования данных и ИИ.

Информационная безопасность

Цифровые инфраструктуры имеют различные уязвимости, которые используются злоумышленниками. Это касается как отдельных лиц, так и организаций. Взлом, кража данных, распространение компьютерных вирусов и других форм кибератак и нарушений кибербезопасности — частые темы в новостях о технологиях. Хотя эти разные угрозы различаются по форме, масштабу и воздействию, их объединяет то, что они представляют собой прямо предназначенные цифровые вторжения либо для незаконного извлечения нематериальных благ (например, данных, информации, финансовых активов), либо для нарушения работы/повреждения цифровой и связанной материальной инфраструктуры. Их можно грубо отнести к одной из двух перекрывающихся категорий: кибервойна и киберпреступность. Оба часто носят глобальный характер, но основные различия между ними заключаются в намерениях субъектов, стоящих за кибератаками. Государственные деятели, такие как военные подразделения или разведывательные службы, обычно стремятся препятствовать техническому прогрессу, красть разведданные и наносить ущерб цифровым объектам других стран. Соответствующие новостные статьи часто фокусируются на злонамеренных действиях, связанных с Китаем, Россией, Ираном или Северной Кореей (например,США опасаются, что данные, украденные китайским хакером, могут идентифицировать шпионов [NYT, 2015]; Следующий фронт кибервойны [NYT, 2017]; Кремль предупреждает о кибервойне после сообщения о взломе российской электросети США [NYT 2019]). В случае с Китаем кибервойна часто изображается как одно из направлений более серьезной геополитической напряженности в отношениях с США и «Западом» в целом (например, «Гамбит Си: Китай планирует мир без американских технологий» [NYT 2021]).

Тесно связана с киберпреступностью, которая принимает форму кражи данных, кибервандализма, вымогательства и преступной деятельности, направленной на получение денежной стоимости с помощью силы или обмана (например, Twitter Vigilantes Are Hunting Crypto Ccammers [Wired, 2021]). В контексте «кибербезопасности» вопросы, связанные с киберпреступностью, часто могут пересекаться с критическими обсуждениями вторжения компаний в частную жизнь посредством отслеживания нежелательных данных (например, « Катастрофа, связанная с обменом местоположением, показывает, насколько вы на самом деле уязвимы»).[Wired, 2018]). В этом контексте новости изображают сбор данных в маркетинговых/рекламных целях как «почти криминальную» деятельность, подрывающую автономию пользователей. Другие тематические новостные статьи направлены на предоставление пользователям советов о том, как лучше защитить свои данные с помощью различных инструментов или настроек программного обеспечения/устройства (например, Lightning YubiKey здесь для уничтожения паролей на вашем iPhone [Wired, 2018]; Получите менеджер паролей. Вот С чего начать [WR, 2018]) .

Более отдаленные новости о киберпреступности могут быть сосредоточены на незаконной торговле через анонимные цифровые сети, такие как темная сеть, на киберпреступления ( Федеральные резервы разгромили торговлю наркотиками в темной сети. Она уже восстанавливается [Wired, 2019]), хотя такие преступные действия не обязательно связаны с данными. извлечение или удаление.

Информационный беспорядок

Более поздний риск, часто упоминаемый в репортажах о технических новостях, касается того, как платформы социальных сетей влияют на структуру и динамику общественных дискурсов: информационный беспорядок, который является общим термином для дезинформации, дезинформации и недостоверной информации (Ireton & Posetti, 2018). Вопросы цифровой пропаганды, раскрутки и особенно «фейковых новостей» стали предметом интенсивных общественных дебатов. В нескольких статьях информационный беспорядок представлен как экзистенциальная угроза демократии (например, The Week in Tech: Democracy Under Siege).[Нью-Йорк Таймс, 2018]). Переломным моментом для этих дебатов стали президентские выборы в США в 2016 году, когда выражение «фейковые новости» стало вирусным во всем мире (Fuchs, 2018). Главной проблемой информационного беспорядка является фрагментация публичных дискурсов и последующее разрушение социальной сплоченности. Однако средства массовой информации также сообщают о попытках найти «средства правовой защиты» (например, One Data Scientist’s Quest to Quash Misinformation [Wired, 2020]; YouTube’s Plot to Silence Conspiracy Theories [Wired, 2020]) и о необходимости регулирования (например, How для регулирования искусственного интеллекта[Нью-Йорк Таймс, 2017]). Интересно, что в некоторых статьях утверждается, что человеческая деятельность предлагает противодействие злонамеренному алгоритмическому распространению контента: «Компьютеры хороши в распространении лжи. Люди могут помочь остановить их и смягчить наносимый ими ущерб» (NYT, 2020).

Различные проявления информационного беспорядка представляют собой формы манипуляции, которые используют коммуникативную логику социальных сетей и алгоритмических систем для распространения информации. Хотя к этим угрозам культуре публичного дискурса следует относиться серьезно, важно учитывать интересы и мотивы новостных организаций в критическом обсуждении информационного беспорядка. Часто предоставляется мало информации о том, какое реальное влияние оказывают «фейковые новости», например, на поведение избирателей, или насколько реальны так называемые «пузыри фильтров» (Bruns, 2019). Особенно основные средства массовой информации оказались в ловушке напряженных отношений зависимости с платформами социальных сетей, что может способствовать сенсационности в освещении проблемы.

Обсуждение

Ведущий исследовательский вопрос настоящего исследования: как средства массовой информации определяют риски, связанные с данными, в своем освещении больших данных и искусственного интеллекта? Основная цель — исследовать, как репортажи о технических новостях могут способствовать формированию критически важной информационной грамотности среди медиа-аудитории.

Что касается осведомленности и видимости рисков, связанных с данными, результаты показывают, что дискурсы англоязычных и западных СМИ стали более внимательными — возможно, чувствительными — к этическим проблемам и вредным последствиям технологий. Наблюдения за дистанционным чтением показывают, что повышенное внимание средств массовой информации к рискам, связанным с данными, шло рука об руку с распространением больших данных и внедрением ИИ в социальных областях. Чем в большем количестве областей появляются технические тренды, тем выше вероятность того, что в новостях будут зафиксированы вредные последствия использования и воздействия. По мере усложнения технологий, управляемых данными, растут и риски, связанные с их широким использованием. У технических репортажей есть реальный потенциал для того, чтобы показать аудитории, какие риски существуют и в каких контекстах они важны для кого.

Есть два аспекта, в которых статьи технических новостей обсуждают риски данных, которые требуют критического осмысления: 1) какие риски данных они покрывают, и 2) способ и степень, в которой они покрывают риски данных. Что касается первого пункта, новостные статьи значительно различаются по тому, как они определяют масштабы воздействия различных рисков, связанных с данными. Вторжение в частную жизнь и слежка за данными кажутся наиболее «установленными» в качестве фокуса дискуссий об этике данных, политике данных и регулировании данных, которые воспринимаются как актуальные для широкого спектра социальных групп. Предвзятость данных — это проблема, в основном связанная с дискриминацией меньшинств; это имеет фундаментальное значение для социальной сплоченности и должно касаться «всех», но по-прежнему рассматривается как проблема, имеющая первостепенное значение только для определенных демографических групп. ОформлениеКибервойна/киберпреступность имеют сильный политический подтекст, но могут включать в себя конкретные советы для отдельных пользователей. Информационное расстройствопредставляется как угроза здоровой демократии, в которой технологические платформы часто изображаются ответственными. Сравнительный анализ показывает, что каждая категория рисков, связанных с данными, стала предметом общественной повестки дня, и они представлены как имеющие в целом одинаковую серьезность в отношении этических проблем. Однако категории рисков, связанных с данными, не являются взаимоисключающими, а описывают различные акценты предполагаемых угроз и/или нежелательных эффектов, связанных с данными и автоматизацией. ИИ, который классифицирует людей на основе, например, поведенческих и демографических данных, может создавать риски смещения данных и наблюдения за данными одновременно. Киберпреступность может принимать форму вторжения в частную жизнь, например, при краже личных данных. Важно наметить весь спектр возможных негативных последствий, вызванных неправильным использованием технологий, основанных на данных, и оценить, как различные риски, связанные с данными, способствуют и потенциально усиливают друг друга. Выводы, полученные в результате тщательного чтения, подразумевают, что сложная взаимная аффективность и взаимосвязь между технологиями, агентством и социальным влиянием часто подразумеваются, но не всегда прямо рассматриваются в технических новостях.

Важно отметить, что список рисков данных не является исчерпывающим, и другие типы, обсуждаемые в литературе, не были обнаружены в ходе анализа. Критические проблемы, такие как цифровой разрыв (van Dijk, 2020), кибернасилие/киберзапугивание (Giumetti and Kowalski, 2022) или зависимость от социальных сетей (Watson, 2022), не стали категориями. По общему признанию, это может быть эффектом выборки, и необходимы дополнительные исследования для оценки степени представления риска данных в новостях в качестве показателя осведомленности общественности. Однако вполне вероятно, что некоторые риски менее достойны освещения, чем другие, по разным причинам, связанным с экономикой внимания современных средств массовой информации.

Что касается степени информированности о рисках, связанных с данными (пункт 2), дистанционное и близкое прочтение показывает, как новостной дискурс с течением времени становится все более критическим. Примером могут служить новости об искусственном интеллекте в NYT, которые в начале 2010-х были сосредоточены на технологических возможностях (например, « Компьютеры учатся слушать» и «Некоторые говорят в ответ» [NYT, 2010]), но в последние годы переключились на опасения по поводу рисков автоматизации (например, « Не боты, которых мы искали [NYT, 2017] Вся эта антиутопия и для чего?[Нью-Йорк Таймс, 2020]). Это не означает, что технические новости сегодня в целом более негативны, чем позитивны. Вместо этого в новостях о технологиях появляются нюансы о балансе ценности и риска больших данных и ИИ, часто представляя как преимущества, так и недостатки конкретных инноваций. Хотя в целом это положительная характеристика, все еще есть новости, которые, кажется, отражают технический ажиотаж и истерию (например, « Холодная война ИИ, которая угрожает всем нам» [Wired, 2018]).

Технические новости, обсуждающие риски, связанные с данными, также различаются в отношении временности и размерности, т. е. некоторые сосредотачиваются на настоящем и конкретном контексте использования, в то время как другие предполагают будущее и широкие социальные последствия (например, «Сможет ли искусственный интеллект улучшить или взломать человечество?» ,[Wired, 2019]). Это может повлиять на то, как риски представляются как «осязаемые». С этим связана различная степень, в которой учитываются риски, связанные с данными. Некоторые статьи предлагают подробные истории, в которых учитываются различные контекстуальные факторы, в то время как другие просто опускают релевантные ключевые слова, которые устанавливают связь между технологиями и определенными рисками, связанными с данными, но без дальнейшего разъяснения, почему и как это важно для социальных групп, которые могут быть затронуты. Риски, связанные с данными, могли стать более заметными в публичных дискуссиях с точки зрения того, как часто они поднимаются, но это не обязательно означает, что соответствующие проблемы и основные причины достаточно освещены для неспециалистов. Непрофессионалам потребуется доступ к дополнительным источникам информации о различных рисках, связанных с данными, например, посредством образования и организационной коммуникации.

Наиболее ощутимую ценность для поддержки грамотности аудитории в отношении критических данных имеют статьи, объясняющие для конкретных контекстов, как датафикация и автоматизация имеют конкретные эффекты и как пользователи могут действовать. В качестве примера можно привести два типа технических новостей: с одной стороны, есть статьи, в которых описывается, как технологические тренды являются политическими проблемами, как методы работы с данными должны быть более этичными и как регулирование может снизить риски (например, Данные изменят мир) . , и мы должны обеспечить правильное управление [Guardian, 2017]; Конфиденциальность — это не то право, от которого можно отказаться[Wired, 2018]). Такой новостной контент обеспечивает необходимые фактические знания для концептуального понимания значения данных и автоматизации для общества, что может сыграть роль в формировании политического мнения. С другой стороны, есть статьи, которые информируют пользователей о том, как они могут защитить себя от различных проявлений рисков, связанных с данными, особенно в отношении личной конфиденциальности и безопасности данных. Это дает полезные практические знания, актуальные для людей, разбирающихся в критических данных. Тем не менее, такие репортажи с критическими возможностями могут быть эффективными только в том случае, если они являются частью непрерывного освещения новостей, которое внимательно отслеживает изменения политики в отношении технических услуг/продуктов и соответствующим образом информирует аудиторию. Чтобы выполнить такую образовательную миссию, сами журналисты должны быть критически грамотными в отношении данных. Исследования показывают, что отдельные технические журналисты хорошо подготовлены для такой задачи (Nguyen & Hekman, 2020b). Тем не менее, необходимо дополнительно изучить, как выглядит ситуация для журналистской профессии в целом.

Подводя итог, можно сказать, что анализ технических новостей показывает, что риски — это контекстно-зависимые дискурсивные конструкции, которые заключают в себе различимые результаты, по крайней мере, частично неопределенных событий. Обсуждения рисков касаются отсутствия контроля над такими потенциальными последствиями. Риски, связанные с данными, по своей сути являются социальными, как и «созданные человеком»; они являются следствием сложных социотехнологических комплексов, возникших за последние сорок лет. Крупномасштабный сбор данных — это возможность как для частных, так и для государственных организаций, в то время как он может представлять угрозу личной свободе граждан/пользователей. Считается ли потенциальный результат риском или нет, может сильно различаться в зависимости от точки зрения заинтересованных сторон и их положения. Для того чтобы граждане могли сформировать мнение и иметь возможность участвовать в дебатах о рисках, связанных с данными, важно, чтобы они знали о потенциальных угрозах, вреде, и этические проблемы. Это напрямую связывает критически важную информационную грамотность с вопросами справедливости в отношении данных (Taylor, 2017), целью которой является повышение чувствительности граждан к рискам, связанным с данными, и повышение устойчивости к неправомерным действиям с данными. Средства массовой информации могут сыграть здесь важную роль, рассматривая социальные последствия на конкретных примерах рисков, связанных с данными, без ажиотажа или истерии. Постепенно они могли бы способствовать политизации больших данных и искусственного интеллекта, превратив их в предметы общественного интереса и, в конечном итоге, парламентской политики. Однако их реальный охват и влияние имеют явные ограничения. Не все, кого затрагивают датафикация и автоматизация, интересуются критическими новостями о них. И не каждый, кто читает такие новости, займет более критическую позицию по отношению к технологическим трендам. Это напрямую связывает критически важную информационную грамотность с вопросами справедливости в отношении данных (Taylor, 2017), целью которой является повышение чувствительности граждан к рискам, связанным с данными, и повышение устойчивости к неправомерным действиям с данными. Средства массовой информации могут сыграть здесь важную роль, рассматривая социальные последствия на конкретных примерах рисков, связанных с данными, без ажиотажа или истерии. Постепенно они могли бы способствовать политизации больших данных и искусственного интеллекта, превратив их в предметы общественного интереса и, в конечном итоге, парламентской политики. Однако их реальный охват и влияние имеют явные ограничения. Не все, кого затрагивают датафикация и автоматизация, интересуются критическими новостями о них. И не каждый, кто читает такие новости, займет более критическую позицию по отношению к технологическим трендам. Это напрямую связывает критически важную информационную грамотность с вопросами справедливости в отношении данных (Taylor, 2017), целью которой является повышение чувствительности граждан к рискам, связанным с данными, и повышение устойчивости к неправомерным действиям с данными. Средства массовой информации могут сыграть здесь важную роль, рассматривая социальные последствия на конкретных примерах рисков, связанных с данными, без ажиотажа или истерии. Постепенно они могли бы способствовать политизации больших данных и искусственного интеллекта, превратив их в предметы общественного интереса и, в конечном итоге, парламентской политики. Однако их реальный охват и влияние имеют явные ограничения. Не все, кого затрагивают датафикация и автоматизация, интересуются критическими новостями о них. И не каждый, кто читает такие новости, займет более критическую позицию по отношению к технологическим трендам. который направлен на повышение чувствительности граждан к рискам, связанным с данными, и на повышение устойчивости к злоупотреблениям в отношении данных. Средства массовой информации могут сыграть здесь важную роль, рассматривая социальные последствия на конкретных примерах рисков, связанных с данными, без ажиотажа или истерии. Постепенно они могли бы способствовать политизации больших данных и искусственного интеллекта, превратив их в предметы общественного интереса и, в конечном итоге, парламентской политики. Однако их реальный охват и влияние имеют явные ограничения. Не все, кого затрагивают датафикация и автоматизация, интересуются критическими новостями о них. И не каждый, кто читает такие новости, займет более критическую позицию по отношению к технологическим трендам. который направлен на повышение чувствительности граждан к рискам, связанным с данными, и на повышение устойчивости к злоупотреблениям в отношении данных. Средства массовой информации могут сыграть здесь важную роль, рассматривая социальные последствия на конкретных примерах рисков, связанных с данными, без ажиотажа или истерии. Постепенно они могли бы способствовать политизации больших данных и искусственного интеллекта, превратив их в предметы общественного интереса и, в конечном итоге, парламентской политики. Однако их реальный охват и влияние имеют явные ограничения. Не все, кого затрагивают датафикация и автоматизация, интересуются критическими новостями о них. И не каждый, кто читает такие новости, займет более критическую позицию по отношению к технологическим трендам. Средства массовой информации могут сыграть здесь важную роль, рассматривая социальные последствия на конкретных примерах рисков, связанных с данными, без ажиотажа или истерии. Постепенно они могли бы способствовать политизации больших данных и искусственного интеллекта, превратив их в предметы общественного интереса и, в конечном итоге, парламентской политики. Однако их реальный охват и влияние имеют явные ограничения. Не все, кого затрагивают датафикация и автоматизация, интересуются критическими новостями о них. И не каждый, кто читает такие новости, займет более критическую позицию по отношению к технологическим трендам. Средства массовой информации могут сыграть здесь важную роль, рассматривая социальные последствия на конкретных примерах рисков, связанных с данными, без ажиотажа или истерии. Постепенно они могли бы способствовать политизации больших данных и искусственного интеллекта, превратив их в предметы общественного интереса и, в конечном итоге, парламентской политики. Однако их реальный охват и влияние имеют явные ограничения. Не все, кого затрагивают датафикация и автоматизация, интересуются критическими новостями о них. И не каждый, кто читает такие новости, займет более критическую позицию по отношению к технологическим трендам. Не все, кого затрагивают датафикация и автоматизация, интересуются критическими новостями о них. И не каждый, кто читает такие новости, займет более критическую позицию по отношению к технологическим трендам. Не все, кого затрагивают датафикация и автоматизация, интересуются критическими новостями о них. И не каждый, кто читает такие новости, займет более критическую позицию по отношению к технологическим трендам.

В дополнение к критическим новостным репортажам как стимулятору общественного дискурса, дополнительные меры могут быть приняты самими организациями, управляемыми данными, и общественными организациями, которые стремятся к расширению прав и возможностей граждан. Любая организация, имеющая дело с данными, должна оценить, какие риски данных применимы к ее деятельности, и разработать четкие и недвусмысленные стратегии информирования о своей политике рисков для своих целевых групп. Важные вопросы, на которые должны быть четкие ответы, включают: какие риски данных относятся к предоставляемым услугам/продуктам? Кто, скорее всего, пострадает? Какие меры принимаются для их смягчения? Как мы можем объяснить различные риски данных способами, доступными для разных целевых групп? Затем регулирующие органы могут захотеть рассмотреть вопрос о том, как организации, работающие с данными, могут быть привлечены к ответственности за это.

Заключение

В этом исследовании изучались риски, связанные с данными, как дискурсивные конструкции в публичных дискуссиях путем критического анализа новостных сообщений о больших данных и искусственном интеллекте. Результаты показывают, что риски, связанные с данными, разнообразны и в разной степени затрагивают различные заинтересованные стороны, однако четыре категории рисков, по-видимому, в значительной степени формируют критические общественные дебаты об этических проблемах цифровой трансформации: вторжение/слежка в частную жизнь, предвзятость данных/алгоритмическая дискриминация, кибербезопасность и информация. расстройство. Новостные репортажи по этим вопросам связаны с грамотностью в отношении критических данных, т. е. базовым концептуальным пониманием того, как эти технологии оказывают социальное воздействие на индивидуальном и общественном уровнях. Документ дополняет теоретизирование социальных последствий датафи- кации и автоматизации, особенно в отношении того, как современные цифровые общества воспринимают и оценивают недостатки и неопределенности технологий. Поскольку риски, связанные с данными, неразрывно связаны с высокодинамичными технологическими разработками и их контекстно-зависимым внедрением, а также последствиями, к их инвентаризации и оценке следует подходить как к почти постоянному процессу.

У настоящего исследования есть несколько ограничений. Выборка ограничена англоязычными изданиями и не полностью репрезентативна для дискуссий о важных данных во всем мире. Необходимо учитывать различия между дискурсивными культурами, и сравнительные исследования могут стать жизнеспособным путем для будущих исследований. Далее, словарный подход, объединяющий ручной и автоматизированный анализы контента, мог пропустить случаи риска данных, которые просто не были обнаружены в предыдущей индуктивно-качественной части. Более продвинутые формы автоматизированного анализа контента с использованием контролируемого машинного обучения могут повысить достоверность методологического подхода. Последующее исследование должно включать более разнообразные текстовые источники для описания публичных дискурсов помимо средств массовой информации (например, социальные сети, материалы по связям с общественностью, аналитические документы). Для выявления и разработки стратегий борьбы с рисками необходим как эмпирический подход к пониманию их глубинных причин, так и критические размышления с нормативно-этической точки зрения. Таким образом, в будущих исследованиях следует рассмотреть изучение взглядов и отношения непрофессиональных аудиторий и изучить регулирующие меры для информирования о рисках, связанных с данными.

Тем не менее, систематическая категоризация обеспечивает основу для дальнейшего эмпирического исследования того, как риски, связанные с данными, дискурсивно конструируются и репрезентируются в публичных дискурсах. Это также отправная точка для разработки подходов к фреймингу, которые делают риски, связанные с данными, понятными для различных аудиторий и могут способствовать повышению грамотности населения в отношении данных. Кроме того, обзор рисков, связанных с данными, может стать основой для коммуникационных стратегий организаций, которые проясняют, как они предвосхищают и решают эти проблемы для защиты интересов пользователей. Риски, связанные с данными, представляют собой коммуникационные проблемы для организаций, которые намерены построить доверительные отношения со своими целевыми группами. Для каждого риска данных требуется своя стратегия минимизации вреда.

Риски, связанные с данными, не неизбежны, а полностью созданы человеком. Это может показаться трюизмом в академических и экспертных дискурсах, но просто не следует ожидать, что непрофессионалы разделят те же самые фундаментальные предположения о технологиях, управляемых данными, особенно когда данные и ИИ часто представляются как свободные от ценностей, объективные, аполитичные. , и беспристрастный.

Литература

Барейс, Дж., и Катценбах, К. (2022). Разговор об ИИ: нарративы и воображаемые национальные стратегии ИИ и их перформативная политика. Наука, технологии и человеческие ценности , 47 (5), 855–881. https://doi.org/10.1177/01622439211030007

Бек, У. (2008). Weltrisikogesellschaft [Общество глобального риска]. Зуркамп Верлаг.

Бенджамин, Р. (2019). Гонка за технологиями: инструменты аболиционистов для нового кода Джима . Политика.

Боллмер, Г. (2018). Теоретизируя цифровые культуры . Мудрец. https://doi.org/10.4135/9781529714760

Бро, П., и Уоллберг, Ф. (2014). Цифровой привратник: СМИ против социальных сетей. Цифровая журналистика , 2 (3), 446–454. https://doi.org/10.1080/21670811.2014.895507

Браунинг, М., и Арриго, Б. (2021). Остановиться и рискнуть: полиция, данные и цифровой век дискриминации. Американский журнал уголовного правосудия , 46 (2), 298–316. https://doi.org/10.1007/s12103-020-09557-x

Брунс, А. (2019). Пузырь фильтра. Обзор интернет-политики , 8 (4). https://doi.org/10.14763/2019.4.1426

Банц, М., и Брагьери, М. (2021). Доктор ИИ примет вас сейчас: оценка освещения ИИ в новостях. ИИ И ОБЩЕСТВО , 37 (1), 9–22. https://doi.org/10.1007/s00146-021-01145-9

Буршер, Б., Флигенхарт, Р., и Вриз, К. (2016). Кадры за пределами слов. Применение кластерного анализа и анализа настроений к освещению в новостях проблемы ядерной энергетики. Компьютерное обозрение социальных наук , 34 (5), 530–545. https://doi.org/10.1177/0894439315596385