По мере того, как дезинформация становится все более безудержной, «предварительное размещение» (prebunking) может помочь дать отпор.

Ранее в этом месяце администрация Байдена представила сенаторам США секретный брифинг об угрозах и перспективах искусственного интеллекта. The Hill сообщил, что сенатор Мартин Хайнрих, демократ из Нью-Мексико, заметил, что «эти модели не созданы для того, чтобы говорить вам правду. Они созданы для того, чтобы дать вам что-то вроде подходящего ответа на английском языке». В середине мая сенатор Ричард Блюменталь, демократ из Коннектикута, пошел еще дальше: он предупредил, что в информационной среде с помощью ИИ будет доминировать дезинформация. Предупреждение Блюменталя стало еще более острым из-за того факта, что его короткая речь была на самом деле написана ChatGPT и произнесена алгоритмом, обученным на его речах, чтобы имитировать его голос .

На протяжении большей части 20-го и начала 21-го веков дезинформация была в первую очередь оружием, используемым государством либо против соперничающей страны, либо против собственного населения. Советский Союз, например, использовал дезинформацию как мощное политическое оружие во время холодной войны. Подобно тому, как появление Интернета изменило экономику дезинформации, наступающая эра генеративного ИИ обещает снова изменить эту экосистему. Это потребует срочного и масштабного применения уроков недавнего прошлого для устранения сопутствующих рисков.

После президентских выборов в США в 2016 году я поехала в Велес в Северной Македонии, небольшой город, который после выборов заслужил сомнительную славу мировой столицы «фейковых новостей».. Там я встретилась с подростками и молодыми людьми, всего несколькими из примерно тысяч, которые зарабатывали на жизнь, удовлетворяя, казалось бы, неограниченный спрос в США на вызывающий ярость политический контент. Молодые люди, с которыми я разговаривал, как оказалось, не интересовались внешней политикой. Многие едва говорили по-английски. Вместо этого они были мотивированы возможностью заработать на жизнь, а возмущение в Интернете могло быть прибыльным. Одна статья, чаще всего состоящая из диковинных утверждений, скопированных и вставленных из другого издания, в сочетании с вызывающим разногласия заголовком, а затем распространенная через пристрастные группы в социальных сетях, могла принести молодым македонцам, с которыми мы встречались, до 1000 долларов.

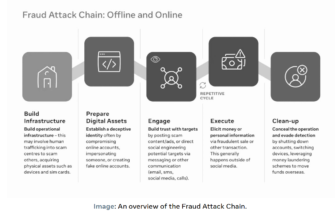

Они были не единственными, кто понял, как использовать платформы, чтобы влиять на людей или даже целые страны. Незадолго до выборов в США, исследуя работу «ферм троллей» в Интернете, моя команда в Jigsaw стала одной из первых, кто обнаружил деятельность тогда еще малоизвестной группы — другой, между прочим, основанной россиянином Евгением Пригожиным, совсем недавно создавшей проблемы в Украине, — которая позже будет идентифицирована как Агентство интернет-исследований.

В ранних исследованиях выделялись три аспекта деятельности группы. Все эти тролль-аккаунты следовали друг за другом, содержание их постов было удивительно похожим, а иногда даже идентичным, и все они размещались в одно и то же время, примерно с 9 утра до 5 вечера по московскому времени. В конце концов, для них это была работа. Эти три качества — относительное сходство, семантическое сходство и временное сходство, среди прочих — впоследствии использовались для выявления множества скрытых операций влияния, позволяющих платформам разрабатывать сложные системы для разрушения таких групп, которые пытались манипулировать платформами для получения финансовой выгоды в 2016 году.

Войдите в генеративный ИИ, который может позволить любому присоединиться к этой игре с информационными операциями, снизив затраты практически до нуля. Наряду с государственными деятелями и спекулянтами фальшивыми новостями как платформам, так и частным лицам, ищущим достоверную информацию, придется бороться с множеством новых игроков с разными мотивами. Для традиционных пропагандистов, поддерживаемых государством, огромный прирост эффективности, обеспечиваемый генеративным ИИ, вероятно, приведет не только к увеличению количества кампаний, но и к более целенаправленным, поскольку создание дезинформации, предназначенной для обращения к нишевым группам, становится экономичным .

Хорошая новость заключается в том, что появление нового поколения технологий генеративного ИИ стимулирует волну инвестиций и формирование новых партнерских отношений между промышленностью и гражданским обществом для устранения надвигающихся рисков. Например, нанесение водяных знаков на контент, созданный искусственным интеллектом , и уникальная проверка людей со всего мира.были предложены в качестве потенциальных подходов к ограничению использования машинно-генерируемого контента для манипулирования. Хотя эти предложения обещают, даже при самых благоприятных обстоятельствах, вполне вероятно, что некоторое количество убедительно созданного человеком, но сгенерированного компьютером контента, пройдет через нашу защиту. В отсутствие всесторонней технической защиты правительствам, платформам социальных сетей, исследователям и гражданскому обществу необходимо лучше снабжать людей способностью идентифицировать для себя контент, предназначенный для манипулирования ими.

В течение последних пяти лет в партнерстве с университетами США и Европы мы в Jigsaw исследовали технику, называемую «предварительной укладкой». Основываясь на работе социального психолога Уильяма МакГуайра в 1960-х годах, предварительная регистрация направлена на то, чтобы помочь людям распознать и опровергнуть манипулятивное содержание до того, как они столкнутся с вводящими в заблуждение утверждениями. Для пребанкинга требуется простая формула: предупреждение о будущих попытках манипуляции; микродоза манипуляции; и подробное объяснение того, как работает эта стратегия манипулирования. Наши прикладные исследованияна эту тему предполагает, что эта простая формулировка может масштабироваться в Интернете: 73 процента людей, которые смотрели видео с предварительным размещением, с большей вероятностью постоянно замечали вводящие в заблуждение заявления в Интернете, а видео с предварительным размещением, показываемые в рекламе на YouTube, повышали распознавание методов манипулирования на 5 процентов.

Предварительное размещение может иметь уникальные преимущества для ограничения вреда от скрытых кампаний влияния в новом мире генеративного ИИ. Государственные субъекты, включая Россию и Иран, будут искать возможности использовать инновации в создании контента, чтобы сеять раздор среди иностранного населения. Используемые ими специфические риторические тактики, в том числе поиск козла отпущения, нагнетание страха или что-нибудь еще, уже давно используются в информационных операциях и будут постоянно появляться вновь. Предоставление людям возможности определять эти распространенные манипулятивные методы может помочь им не стать жертвой этих тактик, независимо от сделанных конкретных заявлений.

В первом крупномасштабном пилотном проекте Jigsaw с партнерами в Центральной и Восточной Европе «предварительное размещение» / prebunking показала себя как эффективный инструмент для широких слоев населения. (Мы выбрали контекст Центральной и Восточной Европы, чтобы опередить то, что, как мы ожидали, будет попыткой России после вторжения демонизировать украинских беженцев в преддверии критических выборов, подобно тому, что русские сделали, используя кризис сирийских беженцев в 2015 году.)

Для проведения кампании мы разработали короткие видеоролики, предваряющие вооружение беженцев, спасающихся от войны в Украине. Запустив YouTube, Facebook, Twitter и TikTok, усилия по предварительному размещению охватили более половины онлайн-населения в Польше, Чехии и Словакии. Одно из видео было посвящено попыткам сделать украинских беженцев козлами отпущения за рост стоимости жизни, в то время как другое подчеркивало разжигание страха по поводу якобы жестокого и опасного характера украинских беженцев. Мы обнаружили, что доля зрителей, которые могли правильно определить эти вводящие в заблуждение приемы, увеличилась на целых 8 процентных пунктов после просмотра всего одного из этих видео — огромное число в контексте рекламы.

Предварительное размещение всегда имело смысл повышать устойчивость к манипулятивным тактикам, но до сих пор никто не нашел способ сделать это в больших масштабах. Тем не менее, как показали наши первые пилотные проекты, усилия недешевы и должны осуществляться с сильными, заслуживающими доверия местными партнерами, которые знают местный контекст и могут поддерживать долгосрочную кампанию. Однако эта модель работает, и объединение частного сектора с аналитическими центрами, медиа-компаниями и другими спонсорами может только помочь.

Это было бы наиболее эффективно в качестве только одной части более крупной и комплексной стратегии по ограничению скрытых кампаний по оказанию влияния, усиленных GenAI. В той мере, в какой настоящий момент был охарактеризован сенатором Генрихом Блюменталем и другими как кризис, он также предоставляет возможность. В совокупности у нас есть инструменты и технологии для принятия упреждающих мер по защите пользователей до того, как они станут мишенями в Интернете. Мы должны использовать их.

Авторка: Yasmin Green

Источник:

https://thedispatch.com/article/fake-news-meets-artificial-intelligence/