Растущее внедрение больших языковых моделей (БЛМ) в исследования политической коммуникации вызвало как энтузиазм, так и опасения. В этой статье мы предлагаем обоснованный и критический обзор распространенных вариантов использования БЛМ в этой области, включая анализ текста, генерацию синтетических данных и эксперименты. Мы утверждаем, что, хотя эти инструменты могут быть привлекательными, они часто вводят серьезные эпистемологические, экологические и инфраструктурные компромиссы, которые недостаточно учитываются. Помимо технических ограничений, мы освещаем более глубокие проблемы, связанные с научной автономией, методологической непрозрачностью, неравенством в ресурсах и корпоративной зависимостью. Вместо того чтобы отвергать инновации, мы выступаем за критическую рефлексию и возобновление приверженности методологической строгости. Рассматривая недостатки БЛМ в современной практике, мы также указываем на жизнеспособные альтернативы. По сути, мы призываем к более целенаправленной, контекстно-чувствительной интеграции БЛМ в социальные науки – интеграции, которая ставит во главу угла прозрачность, устойчивость и научную добросовестность.

Новее, больше, лучше?Сноска1

Быстрое внедрение больших языковых моделей (БЛМ) в исследованиях социальных наук вызвало как восторг, так и беспокойство. Хотя термин «БЛМ» остается расплывчатым и спорным (Rogers & Luccioni,Цитата(2024 ), обычно это относится к генеративным моделям декодирования на основе трансформеров, которые используют астрономические объемы данных для обучения и масштабную серверную инфраструктуру для функционирования. Эти модели, часто доступные только через коммерческие и непрозрачные API, вошли в инструментарий исследователей с удивительной скоростью. Исследователи используют LLM не только для классификации или суммирования текста, но и для генерации синтетических наборов данных, моделирования ответов на опросы и даже для определения того, что следует изучать.

Этот импульс вполне понятен. Исследователями движет стремление изучать новые методы, расширять границы дисциплин и внедрять инновации как в теории, так и на практике. Новые инструменты часто катализируют такой прогресс, вытесняют устаревшие методы и освобождают место для новых. Мы также разделяем энтузиазм по поводу изучения новых инструментов, которые можно использовать. Однако выбор исследовательских инструментов всегда сопряжен с компромиссом. Хотя мы можем добиться некоторого повышения эффективности, используя подходы, основанные на LLM, мы также должны критически осмыслить то, от чего мы отказываемся. В отличие от предыдущих достижений в разработке методов, LLM — это технология, имеющая более широкие последствия для исследований и общества. Поэтому мы призываем к критической рефлексии и утверждаем, что следует переосмыслить внедрение LLM в пользу более обдуманных, методологически обоснованных альтернатив. В этой статье мы предлагаем критический обзор последних тенденций в исследованиях политической коммуникации в отношении внедрения LLM в трех сценариях применения: анализ текста, генерация синтетических данных и эксперименты.

Анализ текста

В области анализа текста линейные модели обучения (ЛМО) все чаще используются для задач классификации различной степени сложности. ЛМО представляют собой перспективное направление, поскольку исследователи полагаются на предварительно обученные модели, которые практически не нуждаются в контекстно-специфических обучающих данных (с малым количеством примеров) или вообще не нуждаются в них (с нулевым количеством примеров), а вместо этого используют короткие инструкции на простом языке — так называемые подсказки — для создания предположительно приемлемых классификаций и меток. Они поддерживают многоязычную обработку, обрабатывают большие контекстные окна, предлагают гибкие интерфейсы для задач обработки естественного языка и даже являются мультимодальными. Их применение к текстовым данным, по-видимому, охватывает весь спектр задач, включая разметку последовательностей (например, распознавание именованных сущностей), обнаружение эмоций или автоматическую разметку тем.

Главная привлекательность линейных моделей обучения (ЛМ) заключается в том, что исследователям достаточно лишь тщательно сформулировать подсказку, никаких технических знаний не требуется. Однако эта сильная зависимость от подсказок также указывает на присущую ЛМ хрупкость. Подсказки необходимо оптимизировать в соответствии с расплывчатыми критериями, и практически невозможно определить, когда именно сформулирована оптимальная подсказка для конкретной задачи. Фактически, это все еще очень активная область исследований с неубедительными результатами (Barrie, Palaiologou, et al.,Цитата2025 ; Бауманн и др.,Цитата2025 ). Одна из стратегий смягчения последствий заключается в том, чтобы рассматривать модели LLM как «краудсорсинг», когда исследователи задают одну или несколько моделей LLM, что приводит к получению данных с псевдослучайной ошибкой. Возможны различные варианты этого подхода, начиная от изменения запроса, модели и параметров (например, температуры). Однако следует с осторожностью подходить к таким методам, поскольку поставщики моделей могут произвольно изменять свои конфигурации, что приводит к невоспроизводимым результатам (Barrie, Palmer, et al.,Цитата2025 г. ) или даже существенно неверные выводы (Бауманн и др.,Цитата2025 ). Недавний пример — попытка OpenAI отказаться от всех моделей GPT-4 в пользу недавно выпущенного семейства GPT-5.

LLM-ы также устраняют необходимость в обширных обучающих данных, предварительной обработке и разработке признаков, что упрощает анализ больших наборов данных для исследователей. Однако растущее использование готовых LLM-инструментов для анализа данных также совпадает с распространением рукописей, в которых игнорируются концепции и теории коммуникации и отсутствуют необходимые проверки (Лоуренс,Цитата2025 ). Как исследователи в области коммуникации, мы должны проявлять осторожность в использовании программ обучения гуманитарным и прикладным наукам без достаточного теоретического обоснования, одновременно используя мощные возможности, которые они предоставляют.

Несмотря на миллиарды параметров и маркетинговые заявления, многоязычные модели анализа текста до сих пор не преодолели проблему языковой предвзятости в вычислительном анализе текста. В частности, многоязычные возможности доступных моделей предвзяты в пользу определенных языков (Хо и Чан,Цитата2023 ). Более того, хотя предвзятость и справедливость известны как проблемы в языковом моделировании, корпоративные создатели LLM, по-видимому, рассматривают эти проблемы как преимущества (Elbouanani et al.,Цитата2025 ). Следует признать, что компании, предлагающие услуги магистратуры в области права, активно работают над повышением справедливости моделей.Сноска2. Однако специалисты по информатике и лингвисты обеспокоены тем, что эти компании не учли более широкие риски, связанные с программами обучения с ограниченным доступом (Church et al.,).Цитата(2023 ). Это подчеркивает, что LLM — это корпоративные продукты , а не обязательно инструменты для исследований. Они подвергаются «улучшениям» и регулярным обновлениям, которые соответствуют потребностям рынка, а не исследователей.

Предыдущие поколения вычислительных инструментов для анализа текста, такие как контролируемое машинное обучение, отличались высокой надежностью и воспроизводимостью. Эти преимущества стали недостатком для локальных моделей машинного обучения (ЛММО), внутренняя работа которых часто непрозрачна не только для пользователей, но даже для компаний, которые их разрабатывают. Хотя проблему воспроизводимости в случае ЛММО можно частично решить, запустив «локальную» ЛММО (Barrie, Palmer, et al.,ЦитатаДаже модели среднего размера (2025 г. ) требуют вычислительных ресурсов, которые часто недоступны исследователям или учреждениям с ограниченным финансированием. Хотя методы сжатия позволяют LLM работать с меньшими ресурсами, они обычно приводят к значительному снижению производительности при решении сложных задач или в языках с ограниченными ресурсами (Marchisio et al.,Цитата2024 г. ) и увеличивают риск систематических ошибок (Бауманн и др.,Цитата2025 ), что делает их непригодными для многих сложных приложений. Недавние исследования показывают, что LLM часто не демонстрируют значительно лучших характеристик, чем более мелкие модели, такие как трансформаторы, состоящие только из энкодера (Bucher & Martini, 2025),Цитата2024 ) или даже машины опорных векторов (Wahba et al.,Цитата2023 ). В некоторых случаях LLM-методы демонстрируют повышение производительности по сравнению с предыдущими методами, но переход к LLM-методам влечет за собой увеличение вычислительных, а следовательно, финансовых и экологических затрат.

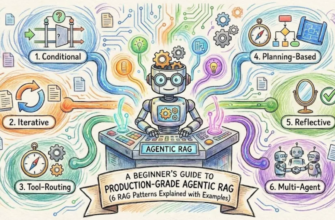

При выборе метода исследования коммуникации необходимо учитывать сложность поставленной задачи. По мере усложнения задач требуются более совершенные методы. Например, измерение общественного мнения требует выявления трех компонентов: оценки чего — либо кем -либо . Люди и LLM-методы могут учитывать все три компонента одновременно; однако при других подходах необходимо создавать конвейер обработки данных для выявления каждого из трех компонентов. Это делает заманчивым использование LLM-методов для всего, поскольку это наиболее универсальный подход. Однако LLM-методы также являются наиболее ресурсоемкими, но часто не обеспечивают производительности, сравнимой с человеческой. Следует тщательно взвесить потенциальные преимущества в производительности и удобство, с одной стороны, и интерпретируемость, воспроизводимость, надежность и (экологическую) стоимость, с другой. При использовании коммерческих LLM-методов также происходит отступление от принципов открытой науки. Вместо того чтобы рассматривать LLM-методы как панацею от всех исследовательских проблем, их следует применять только там, где это оправдано (см.(для наглядной иллюстрации).

Рисунок 1. Схема ментальной модели для визуализации функции компромисса, которую следует учитывать при выборе инструментов из набора инструментов для работы с текстом как данными. На графике показан диапазон возможностей каждого метода: вертикальная шкала указывает на сложность задачи, которую может обработать каждый метод, а горизонтальная шкала показывает ресурсы, необходимые для реализации этого метода для задач в пределах его возможностей. Области перекрываются, поскольку более сложные методы могут также решать более простые задачи: LLM-методы могут делать все, что могут делать словари, но с большими затратами. «Линия оптимального метода» представляет собой наиболее эффективный выбор: наименее ресурсоемкий метод, способный справиться с заданной сложностью задачи.

Синтетические данные

Эпистемологические проблемы, связанные с моделями обучения с использованием синтетических данных, особенно остро стоят при введении синтетических данных в исследования, которые изначально опираются на эмпирические наблюдения за социальной реальностью (Rossi et al.,Цитата2024 ). Социальные ученые придают большое значение обоснованию утверждений наблюдаемым поведением, дискурсом и практикой. Использование сгенерированных моделями «данных» поднимает важные вопросы о том, что считается доказательством (Бисби и др.,Цитата2024 ). Независимо от того, какие данные мы хотим искусственно сгенерировать — будь то ответы на опросы, сообщения в социальных сетях или изображения из новостей — нам необходимо включить в запрос какую-либо форму персоны. Нам также необходимо сделать сомнительное предположение о том, что LLM обладает достаточной широтой знаний (или так называемой «алгоритмической точностью») для моделирования убеждений и взглядов субпопуляций, представляющих эту персону (Амирова и др.,Цитата2024 ).

Первая серьезная проблема заключается в том, что подобные образы приводят к стереотипным представлениям о социальных группах (Ван и др.,Цитата2025 ). Во-вторых, появляется все больше свидетельств того, что LLM-модели могут не достигать приемлемого уровня точности, поскольку их обучающие данные не охватывают весь спектр субпопуляций (Cui et al.,Цитата2025 ). Эти модели недостаточно способны в полной мере отразить все разнообразие демографических показателей и ориентированы, в частности, на западную демографию (Mihalcea et al.,Цитата2025 ; Сен и др.,Цитата2025 г. ) и, по-видимому, даже в сторону определенных политических взглядов (Фон дер Хейде и др.,Цитата2025 ).

Помимо репрезентативности, синтетические данные могут также приводить к существенно неверным выводам, поскольку они демонстрируют меньшую вариативность, чем подлинные данные (Bisbee et al.,).Цитата2024 ). Это вызывает беспокойство не только в отношении синтетических данных опросов, но и в отношении использования LLM для синтеза обучающих данных, таких как расширение текстовых или графических наборов данных. Синтетические данные, используемые для обучения других моделей, вызывают явление регрессии к среднему значению в языковом разнообразии (Guo et al.,Цитата2024 ). В результате такие синтетические или дополненные данные демонстрируют ослабленный набор лингвистических особенностей (например, редкие слова или фразы исчезают), что искажает то, как люди выражают себя (Чен и др.,Цитата(2024 ). Хотя тестирование дизайна исследования с использованием синтетических данных перед выделением ценных исследовательских ресурсов является целесообразным, данные, сгенерированные с помощью LLM, не могут заменить подлинные эмпирические данные; в ограниченной степени они могут играть нишевую роль в генерации синтетических данных для имитационных исследований.

Эксперименты и моделирование

Новаторские работы показывают, что LLM-ы обладают многообещающим потенциалом в создании экспериментальных стимулов (Ван Берло и др.,Цитата(2024 ). В контексте взаимодействия человека и машины исследователи начали изучать влияние разговорных агентов, работающих на основе моделей машинного обучения, на людей. Эти исследования становятся этически проблематичными, когда участники неосознанно взаимодействуют с контентом, сгенерированным моделью, или с ботом. Этические аспекты использования в исследованиях зависят от мер по снижению вреда, таких как информированное согласие (которое, по сути, может быть получено; см. Gelovani et al.,Цитата2025 ). Проекты, основанные на отказе от согласия или его отсутствии, вызывают значительно больше опасений. Недавний случай, когда исследователи использовали ботов на базе LLM на Reddit, чтобы убедить пользователей изменить свое мнение по политическим вопросам, подчеркивает, насколько сложно для этических комитетов в полной мере оценить этичность использования LLM в полевых экспериментах (О’Грэйди,Цитата2025 ).

Исследователи несут полную ответственность за то, как методы LLM применяются в научном процессе. Ван Берло и др. (Цитата(2024 ) утверждают, и мы поддерживаем это мнение, что использование LLM должно быть прозрачным. Исследователи также должны понимать, что информация, передаваемая коммерческим LLM, может использоваться, например, для разработки моделей. Следовательно, исследователи должны проявлять бдительность в отношении риска утечки конфиденциальной информации, как со стороны самих исследователей, так и со стороны участников.

Связанное с этим направление экспериментов включает использование линейных моделей поведения в имитационных исследованиях, где они взаимодействуют друг с другом как агенты (Парк и др.,Цитата2023 ). Такие симуляции представляют собой перспективное направление для агентного моделирования, где возможны более сложные взаимодействия. Однако упомянутые выше присущие им предвзятости и чувствительность к дизайну подсказок могут привести к плохо определенным средам симуляции, что приведет к социально нерелевантным выводам. Это может показаться всего лишь технической проблемой, но важно задаться вопросом, насколько полезны огромные объемы смоделированных разговоров, когда их необходимо анализировать с использованием предвзятых методов анализа текста.Сноска3

Общие вопросы, связанные с LLM

Влияние LLM выходит далеко за рамки наших исследований. Мы, как исследователи и просто как люди, должны заботиться об окружающей среде и социальной справедливости. Мы уже упоминали о высоких вычислительных требованиях LLM и чрезвычайно высоких выбросах CO₂ ( Bommasani et al.,Цитата(2022 ). Экологические издержки LLM огромны: разрушение природной среды для строительства электростанций и центров обработки данных, вредные и негуманные процессы добычи минералов, используемых в производстве графических процессоров, пресная вода для охлаждения центров обработки данных и многое другое (Кроуфорд,Цитата2021 ; Джегам и др.,Цитата2025 ; Ли и др.,Цитата2025 ).

Право собственности на LLM также имеет значение (Тёрнберг и Уитермарк,Цитата2021 ). Исследователи зависят от программ магистратуры в области права, которые разрабатываются и принадлежат наднациональным крупным технологическим компаниям. Эта зависимость рискует подорвать научную автономию, поскольку эти крупные технологические компании диктуют модели ценообразования, ограничения доступа и политику обмена данными. Другим примером этого являются так называемые «ограничения»: автоматические фильтры, которые удаляют вопросы или ответы, которые разработчик программы магистратуры считает нежелательными (Донг и др.,Цитата2024 ). Хотя они необходимы для повышения безопасности программ магистратуры в области права для широкой публики, именно этим крупным технологическим компаниям предстоит решать, какой контент является желательным, а какой нет. Например, модели DeepSeek, как известно, отказываются говорить о площади Тяньаньмэнь и Тайване (Лу,Цитата2025 ; Цзэн и др.,Цитата2025 г. ), в то время как OpenAI случайно добавила имя «Дэвид Майер» в черный список тем, которые их чат-боты отказываются обсуждать (Милмо,Цитата2024 ). Эти во многом неизвестные ограничения важны и должны быть приняты во внимание. Например, исследователи, пытающиеся смоделировать онлайн-дебаты, могут обнаружить, что чат-боты отказываются вести себя токсично, что ограничивает достоверность их синтетических данных.

Заключительные замечания

Наша критика нынешнего необдуманного использования LLM в исследованиях коммуникации указывает на различные негативные последствия. Однако задача ученых не состоит в том, чтобы сопротивляться инновациям. Цель нашей критики — не подтолкнуть наше сообщество от необдуманного использования к другой крайности моральной паники вокруг LLM. При ответственном и этичном использовании LLM потенциально могут решить некоторые застарелые проблемы исследований коммуникации. Например, корректура научных статей с использованием LLM может кардинально изменить ситуацию в преодолении языковых барьеров, с которыми сталкиваются исследователи, для которых английский язык не является родным.

Вместо того чтобы паниковать, нам следует задуматься о социальных, культурных и политических условиях, которые формируют развитие и применение магистерских программ. Если мы этого не сделаем, мы рискуем уступить свою автономию корпоративным интересам, усугубить неравенство между исследователями, обладающими большими и малыми ресурсами, и ввести в заблуждение как общественность, так и само научное сообщество (Rogers & Luccioni,Цитата2024 ). Возможно, среди прочих возможностей, LLM-ы могут представлять собой новый рубеж в аннотировании текста. Но только благодаря тщательному рассмотрению и ответственному использованию их полный потенциал в академической работе может быть реализован. Тогда каков же дальнейший путь?

Во-первых, мы выступаем за компромиссный подход при принятии методологических решений (Рисунок 1). Исследователям следует тщательно обдумать, действительно ли их методологический подход требует использования LLM, или же это можно решить с помощью менее ресурсоемких подходов. Использование LLM может быть оправдано только в том случае, если предыдущие инструменты не дают удовлетворительных результатов. Во-вторых, мы также не рекомендуем использовать коммерческие LLM и предпочитаем использовать модели с открытыми весами или открытым исходным кодом, где известны процедуры обучения и данные, поскольку многие из вышеупомянутых причин указывают на то, что коммерческие предложения представляют собой продукты с ограниченным применением в академических исследованиях. В-третьих, при использовании LLM в исследованиях необходимо разработать строгие методы проверки, которые могут выявить риски и склонность LLM к получению специфических результатов (Baumann et al.,Цитата2025 ). Чтобы предложить другую ментальную модель: LLM — это «стохастические попугаи» (Бендер и др.,Цитата2021 ), которые не могут производить знания, а только извергать их. Мы ловим этих «стохастических попугаев», чтобы помочь нашим исследованиям, но у нас есть лишь смутное представление о том, как они научились говорить (Хикс и др., 2021).Цитата2024 ). В случае с фирменными моделями эти «попугаи» могли улететь по прихоти своего корпоративного владельца.

Наши усилия могли бы быть сосредоточены на восстановлении контроля над моделями обучения с использованием линейных моделей (LLM). Коммерческие LLM с универсальными возможностями могут быть интересны потребителям, но такие возможности, как написание стихов или создание изображений в стиле Гибли, могут оказаться бесполезными для наших исследований. Нам нужны более специализированные модели, создающие научные измерительные инструменты, соответствующие нашим исследовательским требованиям; сокращение ненужных возможностей также уменьшает количество параметров модели и повышает энергоэффективность, что является важным шагом для сокращения выбросов углерода. Для достижения этой цели мы должны иметь полный контроль над всем процессом обучения. Это может показаться сложной задачей, но она уже решалась (например, BigScience Workshop и др.).Цитата2023 г. ); Эрманнтраут и др. (Цитата2025 г. )). Аналогично предыдущим попыткам, индивидуально разработанные модели коммуникации могут быть достигнуты посредством международного сотрудничества.

Мы понимаем, что наши предложения могут быть не идеальными. Поэтому мы предлагаем вам также поразмышлять над нашей текущей практикой в отношении программ магистратуры: как мы можем минимизировать вред от таких программ? Каковы возможные решения?

Что бы вы сделали?

Источник:

Newer, Larger, Better? A Critique of the Unreflective LLM Adoption in Communication Research

https://www.tandfonline.com/doi/full/10.1080/10584609.2026.2618486