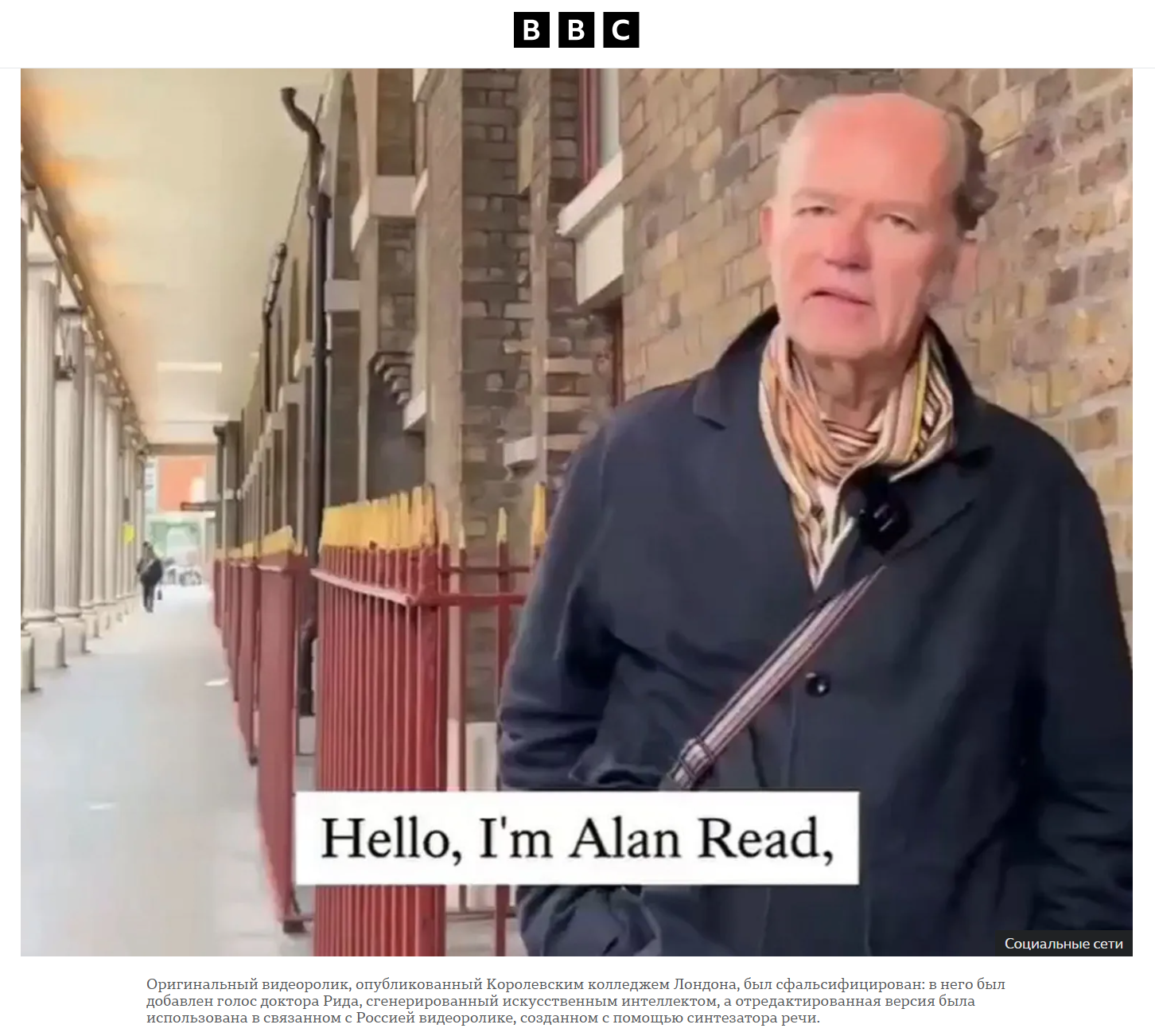

Как и любой заядлый пользователь социальных сетей, профессор Королевского колледжа Лондона Алан Рид не обращал особого внимания на случайные дипфейки, появлявшиеся в его ленте. Иногда он сообщал о них, иногда просто пролистывал ленту.

Однажды какой-то малоизвестный аккаунт отметил его в видео, где было видно его собственное лицо.

В нем синтезированный голос, почти идентичный голосу доктора Рида, разразился политизированной тирадой против президента Франции Эммануэля Макрона, обзывая его и других западных лидеров «находящимися на борту «Титаника», на корпусе которого написано «Европейский союз»».

«Почти всё в этом видео возмутительно и ужасно слушать», — заявил Би-би-си доктор Рид, опытный профессор театрального искусства, не имеющий отношения к политике. «Мне это кажется… совершенно чуждым».

В нем синтезированный голос, почти идентичный голосу доктора Рида, разразился политизированной тирадой против президента Франции Эммануэля Макрона, обзывая его и других западных лидеров «находящимися на борту «Титаника», на корпусе которого написано «Европейский союз»».

«Почти всё в этом видео возмутительно и ужасно слушать», — заявил Би-би-си доктор Рид, опытный профессор театрального искусства, не имеющий отношения к политике. «Мне это кажется… совершенно чуждым».

Аватар ничего не подозревающего доктора Рида появился в новой волне связанных с Россией синтетических видеороликов, которые захлестнули социальные сети за последние месяцы, вызвав обеспокоенность среди экспертов по безопасности тем, что Западу следует готовиться к борьбе с влиянием Кремля на сферу искусственного интеллекта.

«Мы наблюдаем не просто всплеск использования дипфейков, а изменение способов оказания влияния», — заявил Крис Кремидас-Кортни, аналитик по вопросам обороны и безопасности из аналитического центра European Policy Centre.

«Мы сталкиваемся с системами, способными генерировать… убеждение в больших масштабах за копейки. Для меня это революция в политическом влиянии, и ни одна из наших нынешних систем управления не готова к этому».

Эти видеоролики, некоторые из которых набирают сотни тысяч просмотров, дискредитируют институты ЕС и обвиняют киевское правительство в коррупции как раз в тот момент, когда оно борется за финансирование от западных партнеров для борьбы с полномасштабным вторжением России, продолжающимся уже пятый год.

Недавний всплеск активности произошел спустя несколько месяцев после того, как OpenAI выпустила Sora2, последнюю версию своего программного обеспечения для генерации видео, которая совершила скачок в реализме предлагаемого продукта.

В условиях конкуренции за долю рынка в тени технологического гиганта бесчисленные приложения-конкуренты стремились привлечь клиентов, снижая цены или отказываясь от мер безопасности, таких как водяные знаки, которыми Sora2 помечает свои видео, чтобы отличать их от реальных кадров.

«Им нужно привлекать пользователей», — сказал российский эксперт по ИИ Арман Туганбаев, добавив, что, хотя OpenAI пытается пресечь попытки создания видеороликов с участием конкретных людей, «приложения второго эшелона предоставят вам такую возможность».

Компания OpenAI сообщила BBC, что принимает меры против учетных записей, занимающихся обманными действиями, направленными на причинение вреда, в том числе ложными заявлениями об источнике контента.

Технологическая гонка подпитывает неуклонный рост как масштабов, так и изощренности кампаний по оказанию влияния извне, укрепляя позиции России в ее гибридном конфликте с Западом.

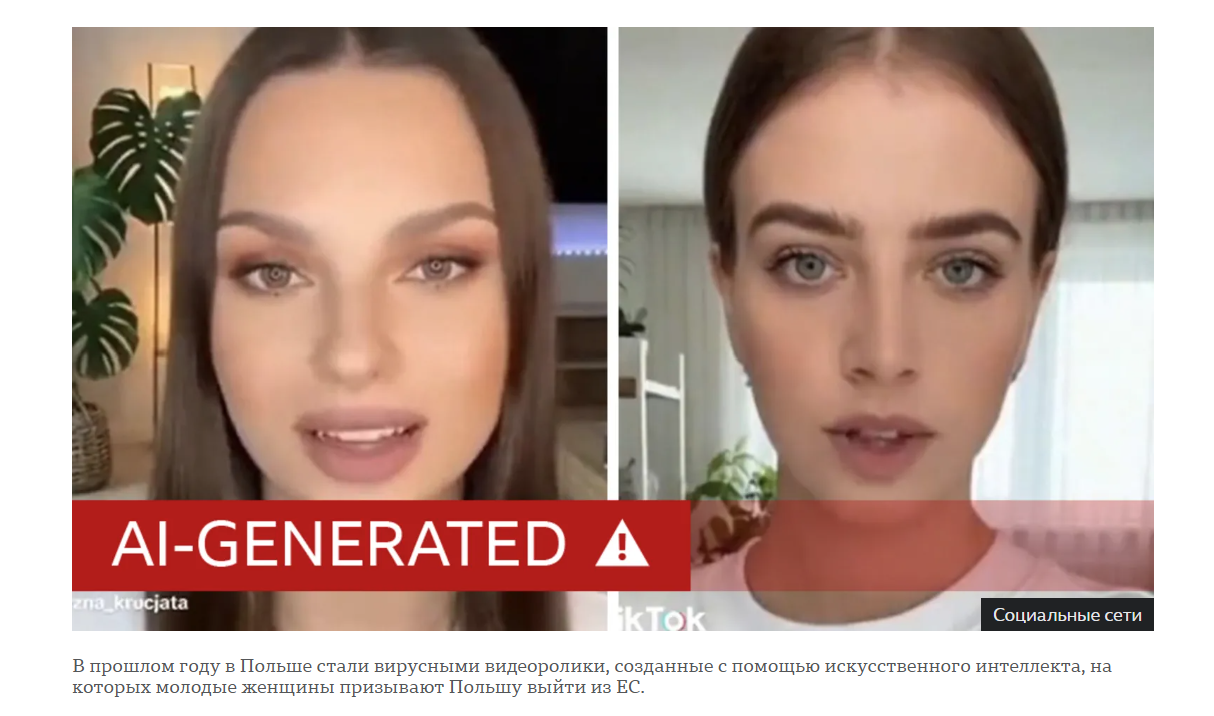

В конце декабря в TikTok распространилась целая серия видеороликов, созданных с помощью искусственного интеллекта, на которых молодые польские женщины призывают к «Полекситу», или выходу Польши из ЕС.

«Нет сомнений, что это российская дезинформация», — заявил Адам Шлапка, пресс-секретарь польского правительства. «Если присмотреться, можно заметить русский синтаксис в этих видеороликах».

Польша призвала Европейскую комиссию провести расследование в отношении TikTok в связи с этим инцидентом.

TikTok, который впоследствии удалил видеоролики и аккаунты, их разместившие, заявил, что в 2025 году он пресек более 75 тайных операций по оказанию влияния в глобальном масштабе.

В Великобритании депутаты обсуждали опасения, что российские дипфейки могут повлиять на местные выборы в мае.

«Мы видели, как их широко использовали на выборах по всему миру, поэтому нет оснований полагать, что Великобритания станет исключением», — заявил законодателям Виджай Рангараджан, исполнительный директор Избирательной комиссии Великобритании.

Британский закон о безопасности в интернете прямо не классифицирует дезинформацию как вред. Однако он обязывает платформы удалять материалы, которые, как можно доказать, являются результатом иностранного влияния — процесс, который часто занимает слишком много времени в онлайн-среде, где видеоролики могут стать вирусными за считанные часы.

Происхождение этих сообщений сложно отследить, но западные исследователи утверждают, что многие из них имеют общие черты — от стилистических особенностей до особенностей распространения — которые связывают их с организованными дезинформационными группами, связанными с Кремлем.

Считается, что одна из кампаний, получившая название «Матрешка» или «Операция Перегрузка», организовала волну синтетических видеороликов, дискредитирующих президента Молдовы Майю Санду во время ее предвыборной кампании 2025 года.

Организация NewsGuard, отслеживающая дезинформацию в интернете, заявила, что обнаружила общие закономерности, указывающие на то, что за видеороликом с участием доктора Рида, вероятно, стоит одна и та же сеть.

Название операции — «матрешки» (русские матрешки) — отражает ее метод, который заключается в том, что первоначальное ложное утверждение облекается в слои репостов из старых или взломанных аккаунтов в социальных сетях.

В отличие от традиционных российских пропагандистских каналов, таких как RT и Sputnik, которые Запад быстро ввел санкции в начале вторжения в Украину, подобные кампании «позволяют добиться уровня… правдоподобного отрицания, что осложняет усилия по противодействию влиянию», — заявила Софи Уильямс-Даннинг, исследователь в области кибербезопасности и технологий из аналитического центра Royal United Services Institute.

Исследователи из Университета Клемсона связали отдельную сеть, получившую название Storm-1516 от Центра анализа угроз Microsoft, с ветеранами кремлевской «фабрики троллей», которой руководил Евгений Пригожин, лидер военизированной группировки Вагнера, до своей смерти в 2023 году.

В готовящемся исследовании, с которым ознакомилась BBC, ученые привели пример того, с какой скоростью распространяются фейковые новости в социальных сетях.

Каждый раз, когда они видели, как кампания «Шторм-1516» распространяет ложную информацию о том, что Владимир Зеленский «коррумпирован», например, эта информация занимала примерно 7,5% всех обсуждений украинского президента на X в течение следующей недели.

«Это то, чем могла бы гордиться любая маркетинговая компания», — сказал Даррен Л. Линвилл, один из авторов статьи.